- Las crisis informáticas surgen de fallos de software, errores de diseño de hardware y decisiones económicas que, combinadas, causan impactos globales.

- Casos históricos como Y2K, Therac-25, Stuxnet o Meltdown y Spectre marcaron la evolución de la ingeniería del software y la ciberseguridad.

- El auge de la inteligencia artificial ha generado una fuerte escasez de GPUs, DRAM y almacenamiento, disparando los precios del hardware.

- La normalización del mercado dependerá de nuevas fábricas de chips y de que el boom de la IA se estabilice en los próximos años.

Las crisis informáticas han acompañado la historia de la tecnología desde sus inicios, pasando de ser pequeños fallos curiosos a auténticos problemas globales capaces de paralizar economías, poner en riesgo vidas humanas o disparar el precio del hardware. Muchas veces pensamos en la informática como algo invisible que simplemente funciona, pero detrás hay decisiones técnicas, errores humanos, limitaciones físicas y contextos económicos que explican por qué todo se ha ido complicando tanto.

Desde los primeros bugs físicos en ordenadores analógicos, pasando por el miedo colectivo del Efecto 2000, los fallos de seguridad masivos como Meltdown y Spectre, hasta la crisis actual del hardware provocada por el auge de la inteligencia artificial, el camino ha estado lleno de tropiezos. Conocer estas historias ayuda a entender mejor por qué hoy hablamos de ciberseguridad, de crisis del software o de burbuja de la IA, y por qué los ordenadores son tan poderosos… pero también tan frágiles.

Qué es una crisis informática y por qué se produce

Cuando hablamos de crisis informática no nos referimos solo a un error puntual, sino a situaciones en las que un problema tecnológico se extiende, escala y tiene impacto real sobre empresas, administraciones públicas o incluso países enteros. A veces el detonante es un bug de software, otras un fallo de diseño de hardware, un ataque de ciberseguridad o incluso decisiones económicas y geopolíticas que afectan a la fabricación de chips.

Una de las causas de fondo es que el desarrollo de software es una disciplina relativamente joven que ha crecido muy rápido, muchas veces sin procesos formales ni personal suficientemente formado. Durante décadas, buena parte de los programadores aprendieron de manera autodidacta, entendiendo la programación casi como un arte más que como una ingeniería estructurada, lo que llevó a proyectos poco documentados, mal planificados y con escasa prevención de errores.

Además, el software no es un objeto físico que se pueda ver o tocar, lo que complica que el cliente exprese exactamente qué necesita y que el equipo técnico lo traduzca en requisitos claros. Cuando la fase de recolección de requisitos se hace deprisa o con poca comunicación, los fallos se cuelan desde el principio y se van arrastrando al diseño, al código y hasta la fase de pruebas, donde ya es mucho más caro corregirlos.

Los estudios clásicos sobre ingeniería del software mostraron que la mayoría de errores se originan en el código fuente (alrededor de un 38 %), seguidos de errores de diseño (24 %), de documentación (13 %), de requisitos (12,5 %) y de correcciones mal implementadas (11,5 %). Sin embargo, un fallo en los requisitos puede ser más costoso que un bug en el código, porque contamina todo el proyecto y puede salir a la luz cuando el sistema ya está en producción.

Por eso, las buenas prácticas apuntan a introducir revisiones formales y control de calidad cuanto antes en el ciclo de vida del software: revisar especificaciones, hacer inspecciones de diseño, revisar código, probar con metodologías serias… Aun así, la realidad es que muchos proyectos siguen fallando por motivos tan humanos como la mala comunicación, el uso inadecuado del software por parte de los usuarios o la falta de formación interna.

La crisis del software: de los años 60 al coste descontrolado

En los años 60 y 70 empezó a hablarse abiertamente de “crisis del software”, un término que describía la incapacidad de las organizaciones para entregar programas fiables, dentro de plazo y dentro del presupuesto. Los sistemas crecían en complejidad, la demanda se disparaba y las técnicas de programación tradicionales se quedaban claramente cortas.

Investigadores como Barry Boehm analizaron el impacto económico del software en Estados Unidos y el mundo. Estimó que, en 1980, el coste total del software en EE. UU. suponía ya alrededor del 2 % del PIB, unos 40 billones de dólares de la época. Para 1985 esa cifra subió hasta 70 billones en Estados Unidos y 140 billones a nivel global, y hacia finales de los 90 los costes se estimaban entre 300 y 400 billones de dólares solo en EE. UU., casi el doble en todo el mundo.

En esas cifras no solo se incluye el coste de desarrollar nuevos sistemas, sino también el mantenimiento posterior cuando el programa ya está en marcha. Es justamente en esa fase donde se detectan muchos de los problemas graves: falta de documentación, código difícil de modificar, plazos irrealistas, parches de urgencia… todo ello consecuencia de la ausencia de una verdadera planificación inicial y de procesos maduros.

El resultado fue que multitud de proyectos terminaban tarde, costaban mucho más de lo previsto, no cumplían bien los requisitos o eran tan frágiles que cualquier cambio rompía el sistema. En algunos casos “solo” suponía sobrecostes millonarios, pero en otros derivó en accidentes con daños materiales importantes, e incluso víctimas mortales cuando el software estaba implicado en sistemas críticos como equipamiento médico o aeronaves.

Errores históricos de software y hardware que lo cambiaron todo

La historia de la informática está llena de anécdotas tan llamativas como preocupantes, que van desde curiosidades simpáticas hasta fallos que han costado vidas humanas o misiones espaciales enteras. Estos casos son hoy material de estudio en ingeniería del software, seguridad y gestión de proyectos.

El primer “bug” literal en un ordenador

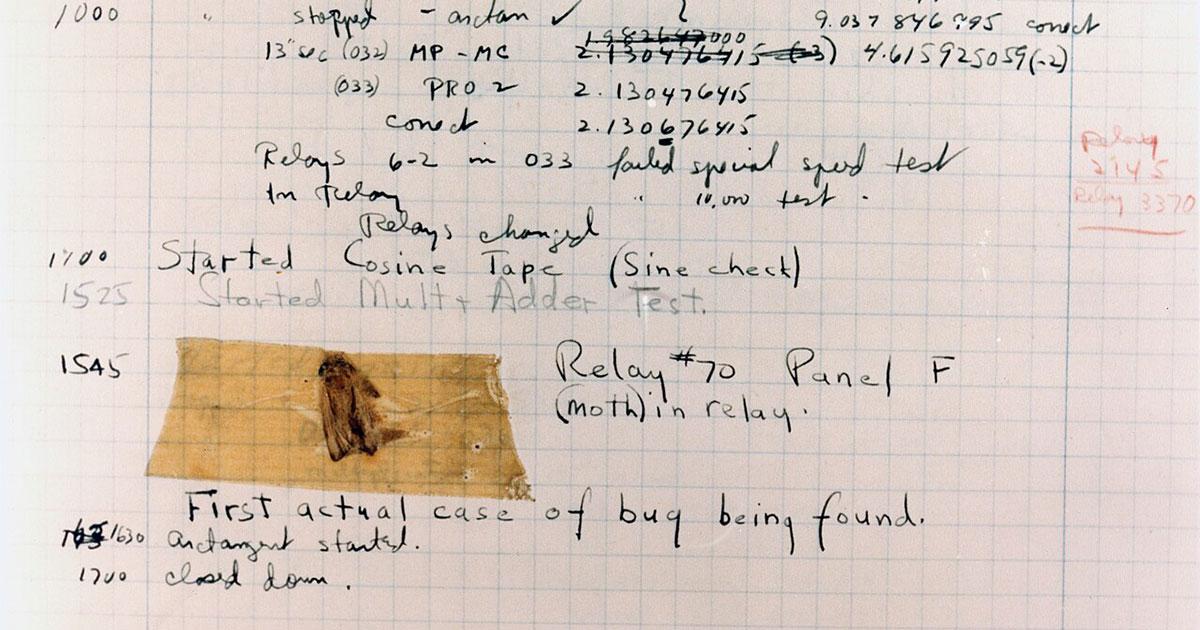

En 1947, los ingenieros que trabajaban en el ordenador Harvard Mark II se encontraron con un fallo muy peculiar. Al revisar los relés de la máquina detectaron que una polilla se había quedado atrapada en uno de ellos, provocando un error en el sistema. Registraron el hallazgo pegando la polilla en el libro de incidencias con una anotación: “first actual case of bug being found”.

A partir de ahí se popularizó el uso de la palabra “bug” para referirse a un fallo informático y “debugging” para el proceso de depuración de errores. Aunque el término ya se usaba en ingeniería para hablar de defectos, aquella anécdota se convirtió en parte de la mitología de la informática moderna.

Pentium y los cálculos matemáticos incorrectos

En 1994, Intel lanzó una generación de procesadores Pentium afectada por un fallo en la unidad de punto flotante. El error hacía que determinadas operaciones matemáticas con muchos decimales (más de 8 cifras) devolvieran resultados incorrectos, sin que importase el sistema operativo o el programa utilizado: el problema estaba en el propio hardware.

Para el usuario doméstico el impacto fue limitado, pero en sectores como la banca o la investigación científica, donde se realizan cálculos muy precisos, el fallo podía tener consecuencias serias. La polémica fue tan grande que Intel tuvo que organizar un programa masivo de sustitución de procesadores, con un coste estimado de más de 475 millones de dólares para reparar el daño y recuperar la confianza.

Therac-25: el software que mató pacientes

Uno de los episodios más trágicos relacionados con errores de software en sistemas críticos fue el caso del acelerador médico Therac-25, utilizado en hospitales de Estados Unidos y Canadá durante los años 80 para tratar cáncer con radioterapia.

La versión anterior de la máquina se apoyaba más en mecanismos de seguridad hardware, pero en el Therac-25 se sustituyeron algunos de esos mecanismos físicos por software de control. Ese programa fue desarrollado sin una formación adecuada en ingeniería del software crítico y con un proceso de validación insuficiente, lo que permitió que se colaran varios bugs graves.

El resultado fueron sobredosis masivas de radiación en varios pacientes, que recibieron dosis decenas o cientos de veces superiores a las previstas. Entre 1985 y 1987 al menos cinco personas murieron como consecuencia directa de estos fallos, y otras resultaron gravemente heridas. El caso se convirtió en un referente sobre cómo no diseñar ni validar software médico.

Errores que casi desatan guerras o arruinan bancos

No todos los fallos informáticos se quedan en anécdotas técnicas; algunos han estado a punto de cambiar el rumbo de la historia contemporánea. Un ejemplo inquietante es el incidente del 23 de septiembre de 1983, en plena Guerra Fría.

Aquella noche, un sistema de alerta temprana soviético detectó supuestamente el lanzamiento de cinco misiles balísticos estadounidenses. El teniente coronel Stanislav Petrov era el oficial de guardia y tuvo que decidir si informaba de un ataque real o clasificaba lo ocurrido como una falsa alarma. Durante cinco minutos interminables debatió con su equipo, valoró la lógica estratégica y decidió no escalar el aviso.

Los misiles nunca llegaron porque el sistema de detección estaba equivocado: se había producido un fallo en el software de interpretación de señales, influido por condiciones atmosféricas y de iluminación. Si Petrov hubiera seguido el protocolo a rajatabla, podría haberse desencadenado una respuesta nuclear soviética, con consecuencias inimaginables.

En el ámbito económico, en 1986 el Bank of America emprendió el desarrollo de un sistema llamado MasterNet para gestionar contabilidad y reportes de fideicomisos. El presupuesto inicial era de unos 23 millones de dólares, pero el proyecto se complicó tanto que terminaron invirtiendo alrededor de 60 millones adicionales. A pesar de ello, el sistema nunca alcanzó el nivel esperado y tuvo que ser cancelado, ejemplificando el clásico caso de sobrecoste, retrasos y fracaso total por mala gestión de un proyecto de software.

Misiones espaciales perdidas por un guion o por las unidades

La exploración espacial también ha sufrido las consecuencias de fallos informáticos aparentemente mínimos. En 1962, la NASA perdió la sonda Mariner 1 poco después de su lanzamiento por un simple error tipográfico: faltaba un guion en una línea de código que definía una ecuación de guiado.

Ese minúsculo detalle provocó que la trayectoria de la nave se descontrolara, obligando a activar la autodestrucción por motivos de seguridad. El coste del fracaso se cifró en unos 18,5 millones de dólares y se convirtió en uno de los ejemplos más citados de por qué es vital revisar y probar cada línea de código en sistemas críticos.

Décadas más tarde, en 1999, la NASA perdió el Mars Climate Orbiter por un fallo de conversión de unidades. Parte del equipo utilizaba el sistema métrico decimal (newtons, metros), mientras que otro trabajaba con unidades imperiales (libras, pies). La falta de una estandarización clara hizo que se mezclaran ambos sistemas en los cálculos de navegación.

La consecuencia fue que la sonda entró demasiado baja en la atmósfera marciana, se sobrecalentó y se destruyó, con una pérdida estimada de más de 125 millones de dólares. Este caso se cita a menudo como recordatorio de que la coordinación y la documentación entre equipos son tan importantes como la propia calidad del código.

Virus Stuxnet y la era de la ciberguerra

En 2010 salió a la luz Stuxnet, un malware altamente sofisticado diseñado para atacar sistemas industriales, en concreto las centrifugadoras del programa nuclear iraní. A diferencia de otros virus orientados a robar datos o bloquear equipos, Stuxnet estaba hecho a medida para sabotear un objetivo físico concreto.

El gusano se infiltraba en controladores industriales (PLC) y sistemas SCADA, modificando de forma encubierta la velocidad de las centrifugadoras mientras enviaba lecturas normales a los paneles de control. Así, el equipo humano creía que todo iba bien mientras las máquinas se dañaban poco a poco.

Aunque nunca se ha reconocido oficialmente, se cree que fue desarrollado por Estados Unidos e Israel como parte de una operación encubierta para retrasar el programa nuclear de Irán. Stuxnet marcó un antes y un después al demostrar que una crisis informática puede tener consecuencias directas en infraestructuras críticas y en el equilibrio geopolítico.

Errores cotidianos que cuestan millones

En 2011, un libro académico de biología titulado “The Making of a Fly” alcanzó un precio absurdo de más de 23 millones de dólares en Amazon. La razón no fue una joya oculta de la ciencia, sino un fallo de configuración en algoritmos de fijación de precios utilizados por varios vendedores.

Cada vendedor había programado su algoritmo para ajustar el precio en función del competidor, de manera automática. En lugar de converger a un precio razonable, se generó un bucle de realimentación que elevó el valor del libro a cifras astronómicas antes de que alguien se diera cuenta y lo corrigiera. Un ejemplo perfecto de cómo la automatización sin control humano puede producir resultados ridículos.

Otro caso curioso es el de James Howells, un informático galés que en 2013 tiró a la basura un disco duro que contenía unas 8.000 unidades de bitcoin, cuando todavía valían relativamente poco. A medida que la criptomoneda se revalorizó, ese disco duro llegó a representar cientos de millones de dólares perdidos, motivando múltiples intentos por recuperar el dispositivo en un vertedero… sin éxito hasta la fecha.

Estos episodios ponen de relieve que la gestión de datos y copias de seguridad es casi tan importante como la propia seguridad frente a ataques: un simple descuido doméstico puede tener consecuencias económicas enormes.

Y2K, Efecto 2038 y el origen del enfoque moderno de ciberseguridad

El llamado “Efecto 2000” o bug Y2K fue uno de los hitos más mediáticos de la historia de la informática. Durante los años 90 se temía que, al llegar el 1 de enero del año 2000, multitud de sistemas dejaran de funcionar correctamente, provocando fallos en bancos, aerolíneas, centrales eléctricas y todo tipo de infraestructuras.

La raíz del problema estaba en que muchos programas almacenaban el año con solo dos dígitos (por ejemplo, 98 en lugar de 1998) para ahorrar memoria, algo razonable cuando los recursos eran escasos y se asumía que el software no seguiría en uso más allá de 1999. Al llegar el año 2000, la fecha “00” podía interpretarse como 1900, generando desajustes en calendarios, cálculos de intereses, caducidades o programación de tareas automáticas.

Aunque en la práctica el cambio de milenio se produjo sin las catástrofes apocalípticas que muchos auguraban, eso no significa que el problema fuera un invento. Gobiernos, grandes corporaciones y expertos en ciberseguridad invirtieron miles de millones en revisar y corregir sistemas críticos para evitar que el fallo se manifestara a lo grande.

Especialistas como Martyn Thomas, profesor de Tecnología de la Información, han defendido que la amenaza era muy real y que solo una acción coordinada masiva evitó que los sistemas se colapsaran. Se revisaron cajeros automáticos, redes eléctricas, sistemas de transporte, bases de datos gubernamentales… todo con el objetivo de que la transición al 2000 fuera transparente para la población.

Una parte de las soluciones consistió en aplicar parches que cambiaban el año de referencia o extendían el rango de fechas sin rediseñar por completo los sistemas. En algunos casos se adoptaron enfoques que simplemente aplazaban el problema, asumiendo que para cuando volviera a ser un riesgo ya se habría renovado la tecnología.

Sin embargo, en 2020 se vieron pequeños coletazos de decisiones tomadas años atrás. Por ejemplo, parquímetros de Nueva York dejaron de procesar pagos correctamente y algunos videojuegos como WWE 2K20 tuvieron fallos al cruzar el año nuevo, obligando a los usuarios a cambiar manualmente la fecha a 2019 para poder jugar. Demostraron que los parches “rápidos” pueden volver a morderte con el tiempo.

Mirando al futuro aparece el llamado Efecto 2038, que afecta principalmente a sistemas basados en Unix y derivados (incluyendo muchos dispositivos y servidores actuales). Estos sistemas cuentan el tiempo como el número de segundos transcurridos desde el 1 de enero de 1970; cuando ese contador alcance su límite en 2038, los sistemas que no estén preparados podrían experimentar desbordamientos y comportamientos extraños.

El miedo al Y2K y la gestión de estas amenazas se consideran hoy el punto de partida del enfoque moderno de la ciberseguridad basado en la prevención. Grandes ciberataques posteriores como WannaCry, Petya o Conficker reforzaron la idea de que no basta con reaccionar: hay que adelantarse, analizar riesgos y actualizar sistemas de forma continua.

Expertos del sector, como responsables de empresas de seguridad, insisten en que en ciberseguridad rara vez hay segundas oportunidades: un fallo sin parchear, una actualización crítica pospuesta o una mala configuración puede desembocar en una crisis que afecte a toda una organización en cuestión de horas.

Meltdown, Spectre y el despertar frente a los fallos de diseño en CPU

En 2018 salieron a la luz Meltdown y Spectre, dos vulnerabilidades masivas en procesadores de Intel, AMD y ARM, entre otros. Por primera vez muchos usuarios tomaron conciencia de que el problema no estaba solo en el software, sino también en el propio diseño del hardware que utilizamos a diario en ordenadores, móviles y servidores.

Ambas vulnerabilidades se aprovechaban de técnicas de ejecución especulativa y cachés internas de las CPU modernas, que se utilizan para mejorar el rendimiento. Mediante ataques de canal lateral era posible, en determinadas condiciones, leer información sensible de la memoria, rompiendo el aislamiento entre procesos y permitiendo potencialmente robar datos como contraseñas o claves de cifrado.

Meltdown afectaba sobre todo a procesadores Intel de varias generaciones, mientras que Spectre tenía un alcance más amplio e impactaba también en diseños de otros fabricantes. Las soluciones pasaron por actualizaciones de sistema operativo, microcódigo y cambios en compiladores, con el coste añadido de una posible pérdida de rendimiento en ciertas cargas de trabajo.

Este episodio evidenció que la seguridad debe estar integrada desde la fase de diseño del hardware, y que no se puede dar por sentado que la CPU es una “caja negra” confiable. También demostró la enorme dificultad de parchear vulnerabilidades cuando están tan profundamente incrustadas en la arquitectura básica de los dispositivos.

Caídas globales: cuando un fallo tira abajo medio planeta

La creciente dependencia de plataformas centralizadas ha provocado que un simple error de configuración pueda sentirse en todo el mundo. Un ejemplo reciente muy mediático fue la caída simultánea de Facebook, Instagram y WhatsApp en 2021.

Durante varias horas, un problema en una actualización interna de la infraestructura de Facebook dejó inaccesibles estos servicios a nivel global. Más allá del impacto en la comunicación personal, la interrupción afectó a empresas que usan WhatsApp Business, a servicios de autenticación que dependen de Facebook Login y a negocios que basan gran parte de su presencia digital en estas redes.

Este tipo de incidentes nos recuerda lo frágil que puede ser la infraestructura digital: una configuración errónea en un sistema de enrutamiento o en un servicio DNS puede dejar grandes partes de Internet inalcanzables. Y cuanto más centralizamos servicios en unas pocas compañías, mayor es el riesgo de que un fallo puntual tenga efectos en cadena.

La nueva gran crisis: boom de la IA y escasez de hardware

En los últimos años hemos pasado de hablar de crisis del software a enfrentarnos a una crisis del hardware provocada por el auge de la inteligencia artificial. Tras la pandemia de 2020-2023, la demanda tecnológica ya venía tensionada por problemas logísticos y de suministro; sobre esa base se ha sumado la explosión de modelos generativos, IA en la nube y edge computing.

Las grandes tecnológicas y multitud de empresas de todos los sectores se han lanzado a adoptar servicios de IA como si fueran la solución a todos los problemas, impulsadas por casos de éxito de compañías como OpenAI o DeepSeek y por el crecimiento espectacular de fabricantes de hardware como NVIDIA. Lo que comenzó pareciendo una moda pasajera se ha convertido en un boom sostenido, con una demanda que sigue creciendo y arrastrando a toda la cadena de valor.

El resultado es una presión tremenda sobre las infraestructuras de centros de datos, que ahora deben gestionar modelos cada vez más grandes, entrenamientos intensivos y despliegues masivos de inferencia. Esta nueva realidad está reconfigurando el mercado de GPUs, memorias RAM, almacenamiento y redes de alta velocidad, con efectos directos sobre los precios que paga el usuario final.

Necesidades de hardware en la era de la IA

Los centros de datos modernos dedicados a IA requieren unas capacidades de cómputo, memoria y conectividad sin precedentes. Los modelos generativos necesitan enormes cantidades de operaciones por segundo y vastos volúmenes de datos en memoria, algo que las arquitecturas tradicionales de CPU no pueden manejar de forma eficiente por sí solas.

Por eso, el corazón de esta nueva infraestructura son las GPUs y aceleradores especializados (TPU, ASICs, etc.), como las TPU de Google, las series H100 y Blackwell de NVIDIA o las tarjetas AMD Instinct. Estas soluciones están optimizadas para cálculos en precisión reducida, multiplicaciones de matrices y operaciones masivas en paralelo, algo fundamental para el entrenamiento y la inferencia de modelos de IA.

Ligado a esto, las plataformas de IA exigen una cantidad de memoria descomunal. No se trata solo de la RAM convencional de la CPU, sino de memorias de alto ancho de banda como HBM (High Bandwidth Memory) integradas junto a las GPUs para proporcionar VRAM con tasas de transferencia gigantescas. Esta combinación ha generado una demanda voraz de chips DRAM y HBM que está absorbiendo prácticamente toda la producción disponible.

Los datos utilizados por la IA también necesitan almacenamientos masivos y redes ultrarrápidas. Los centros de datos combinan SSDs NVMe de alto rendimiento para datos activos con HDDs de gran capacidad para almacenamiento “nearline” o en frío de enormes conjuntos de datos históricos. Además, las interconexiones entre nodos y racks se basan en enlaces de 100, 200 o 400 Gbps mediante Ethernet avanzada, InfiniBand u otras tecnologías, lo que dispara la demanda de equipamiento de red de gama alta.

Todo esto tiene un coste energético importante: los clústeres de IA consumen cantidades de electricidad equivalentes a las de pequeñas ciudades, lo que preocupa tanto por el impacto ambiental como por la sostenibilidad económica a largo plazo. Las inversiones en refrigeración, fuentes de alimentación y centros de datos adaptados son cada vez mayores.

GPUs: epicentro de la crisis actual

Dentro de esta tormenta perfecta, el mercado de las GPU se ha convertido en el centro neurálgico de la crisis. Fue el primer segmento en disparar sus ingresos gracias al boom de la IA, pero también el primero en trasladar la presión de la demanda en forma de escasez y subida de precios, algo que ya se vivió parcialmente durante la fiebre de las criptomonedas, pero ahora a otra escala.

Las grandes empresas y proveedores de nube acaparan el stock de GPUs de gama alta para montar sus granjas de IA, lo que deja pocas unidades disponibles para estaciones de trabajo profesionales tradicionales o para el mercado de consumo y gaming. Ante esta realidad, muchos diseñadores y fabricantes han decidido priorizar los modelos destinados a centros de datos, porque son mucho más rentables que las tarjetas de consumo.

Esta reorientación provoca que no solo falten GPUs “de IA”, sino también modelos para jugadores y creadores. La producción se vuelca donde hay márgenes más altos, y el resto del mercado se ve relegado. Menos unidades disponibles en el canal de consumo significa precios disparados para las pocas tarjetas que llegan realmente a las tiendas.

De esta forma, la combinación de demanda brutal de centros de datos y cambio estratégico de los fabricantes ha encarecido notablemente las GPUs para el usuario de a pie, que se encuentra con precios desorbitados y difíciles de asumir para actualizar su PC o montar un equipo nuevo.

La memoria RAM y DRAM, otra gran víctima

Desde finales de 2025 se ha hecho evidente que la memoria DRAM es otro de los grandes cuellos de botella de esta crisis. La misma infraestructura que dispara la demanda de GPUs exige cantidades ingentes de DRAM para servidores, módulos de RAM de alta capacidad y chips HBM para acompañar a los aceleradores de IA.

Grandes fabricantes como Samsung Electronics, SK Hynix y Micron Technology han ido destinando cada vez más parte de su capacidad productiva a memorias de alto valor añadido, como DRAM para servidores e HBM, porque son las que generan más margen y están ligadas a contratos multimillonarios con grandes nubes y proveedores de IA.

Este cambio de enfoque ha comprimido fuertemente el suministro de DRAM para el mercado tradicional de consumo: PCs, portátiles, smartphones, Smart TVs, routers y otros dispositivos que también dependen de estos chips se han visto afectados por la escasez y, por tanto, por un aumento de precios sin precedentes.

En algunos casos, se ha llegado a ver módulos DDR5 de alta gama a precios de varios miles de euros, algo impensable hace unos años. Marcas orientadas al usuario final han sufrido especialmente este contexto. Un ejemplo simbólico es Crucial, la marca de consumo de Micron, que anunció el cese de la producción de RAM y SSD bajo ese nombre a partir de febrero de 2026, reflejando el giro claro hacia productos más rentables para centros de datos.

Todo esto se produce en un mercado de DRAM históricamente cíclico y volátil. Tras periodos de sobreproducción y caída de precios, los fabricantes reducen capacidad para evitar pérdidas; si justo después se produce un boom como el de la IA, el choque entre menor oferta y demanda disparada genera un ajuste brusco que lleva los precios a niveles muy altos.

Escasez y tensiones en SSD y HDD

La crisis no se limita a GPU y RAM: el mercado de SSD y HDD también ha entrado en tensión. La rápida expansión de la IA ha multiplicado la necesidad de almacenamiento de alto rendimiento para datos activos, pero también de grandes volúmenes para datos fríos y copias de seguridad.

Esto ha provocado, por un lado, que muchas unidades SSD empresariales de alta densidad tengan una demanda explosiva, y por otro que se sigan utilizando masivamente HDDs “nearline” para almacenamiento en frío, donde el precio por terabyte sigue siendo imbatible. Los grandes centros de datos, por tanto, compran tanto SSD como HDD en cantidades enormes.

Fabricantes de memoria NAND como Samsung, SK Hynix y Micron veían venir periodos de sobreoferta en los que los precios habían caído mucho, por lo que recortaron producción para estabilizar el mercado. Justo cuando esa capacidad estaba reducida, llegó la explosión de la IA, generando un nuevo choque entre oferta limitada y demanda creciente.

En el mundo de los HDD, compañías como Western Digital y Seagate también han notado el impacto. Se han dado casos en los que toda la producción y el stock disponible estaban ya asignados a grandes clientes incluso antes de llegar al canal minorista, con la consiguiente escasez para integradores pequeños y usuarios finales.

Todo esto refuerza la idea de que, en la práctica, la IA está absorbiendo buena parte de la producción mundial de componentes clave, dejando al resto del mercado adaptarse como puede, generalmente a base de pagar más y esperar más tiempo para conseguir hardware.

Consecuencias directas para el usuario y el mercado global

En 2026 el impacto sobre el consumidor se ha vuelto difícil de ignorar: montar o actualizar un PC se ha encarecido de forma notable, especialmente en lo que respecta a tarjetas gráficas, módulos de RAM y unidades de almacenamiento. Y esto no solo afecta a entusiastas, sino a cualquier empresa o particular que necesite renovar equipos.

Los chips DRAM y la memoria flash NAND están presentes en prácticamente todos los dispositivos electrónicos: ordenadores, teléfonos, consolas, routers, domótica, televisores inteligentes… Cuando estos componentes suben de precio, toda la cadena de productos finales se encarece. Para muchos usuarios, la opción pasa por aguantar con equipos viejos, recurrir a la segunda mano o sacrificar prestaciones.

Ante este escenario, empiezan a ganar visibilidad nuevos fabricantes chinos de memoria y almacenamiento, que ven una oportunidad en el segmento de consumo descuidado por los grandes. Compañías como CXMT (ChangXin Memory Technologies) han desarrollado módulos DDR5-8000, mientras que YMTC (Yangtze Memory Technologies) impulsa chips NAND con su arquitectura Xtacking 4.0, capaces de apilar muchas capas y alcanzar capacidades de hasta 8 TB en SSDs.

También aparece XMC (Wuhan Xinxin) como actor de apoyo en la cadena de suministro de este ecosistema chino. Marcas de consumo como Netac, Asgard, KingBank o Gloway ya utilizan estos chips en algunos de sus productos, aunque todavía no han conseguido una adopción masiva por parte de marcas occidentales consolidadas como Kingston o Corsair.

La situación llega a extremos curiosos, como iniciativas en Rusia para fabricar módulos de RAM caseros (“DIY”) ante la dificultad para acceder a ciertos componentes por precio o por restricciones geopolíticas. Ejemplos así reflejan hasta qué punto el suministro de hardware se ha convertido en un asunto estratégico.

Cuándo podría normalizarse el mercado del hardware

Según análisis de firmas como TrendForce e IDC, el momento actual se considera uno de los puntos más críticos de la crisis de hardware. El problema no es tanto la falta de materias primas, sino la falta de capacidad de fabricación (fabs) suficiente para cubrir toda la demanda de chips de memoria, GPUs y otros componentes avanzados.

Construir una nueva fábrica de semiconductores es un proceso extremadamente caro y lento: requiere inversiones de miles de millones de dólares y plazos que suelen rondar entre los 3 y 5 años desde la planificación hasta que la producción es significativa. Por ello, la respuesta de la industria nunca puede ser inmediata.

Los pronósticos apuntan a que hacia finales de 2026 se podría empezar a ver una estabilización de precios, en el sentido de que dejarán de subir de forma tan agresiva. Esto coincidiría con la entrada en funcionamiento de algunas ampliaciones de capacidad ya en marcha y con un posible enfriamiento o saturación parcial del boom inicial de la IA.

Para 2027 se espera que nuevas fábricas, como instalaciones adicionales de Micron en Singapur o proyectos de SK Hynix en Corea, empiecen a aportar más producción de DRAM y HBM. Si la demanda de IA se estabiliza y no se disparan nuevas necesidades imprevistas, esta capacidad adicional podría relajar la situación.

Los escenarios más optimistas contemplan que no antes de 2028 se verá una caída clara de precios, sobre todo si el auge de la IA se modera o entra en una fase más madura. En ese caso, la capacidad de fabricación podría superar temporalmente la demanda, generando un exceso de stock similar al que permitió ver auténticas gangas en memorias y SSD en 2023.

En cualquier caso, lo que muestran todas estas historias, desde los primeros bugs hasta la crisis actual de la IA, es que la informática y su infraestructura siempre se han movido entre el avance espectacular y el tropiezo constante, y que entender sus crisis ayuda a tomar mejores decisiones técnicas, empresariales y personales a la hora de depender de una tecnología que es tan poderosa como delicada.