- El ISP transforma los datos crudos del sensor en imágenes optimizadas aplicando demosaico, balance de blancos, reducción de ruido, color y HDR.

- Su arquitectura combina A/D, procesado digital y memoria, y hoy integra IA para mejorar baja luz, rango dinámico y detalle.

- La calidad final depende del conjunto sensor‑óptica‑ISP‑algoritmos, no solo de los megapíxeles ni del tamaño del sensor.

Las fotos que hacemos con el móvil o con una cámara digital no salen “perfectas” por arte de magia: detrás hay un conjunto de algoritmos y hardware que exprimen cada fotón para convertir datos crudos del sensor en imágenes bonitas y útiles. Ese cerebro invisible se llama ISP, el procesador de señal de imagen.

En el día a día escuchamos mucho sobre megapíxeles, sensores o lentes, pero el ISP suele pasar desapercibido. Aun así, su papel es clave en el rango dinámico, el color, el ruido, el enfoque y la compresión que ves en pantalla y en el archivo final (JPG, RAW o vídeo). Si alguna vez te preguntaste por qué dos móviles con el mismo sensor rinden diferente, la respuesta corta es: su ISP y sus algoritmos marcan la diferencia.

¿Qué es un ISP (Image Signal Processor)?

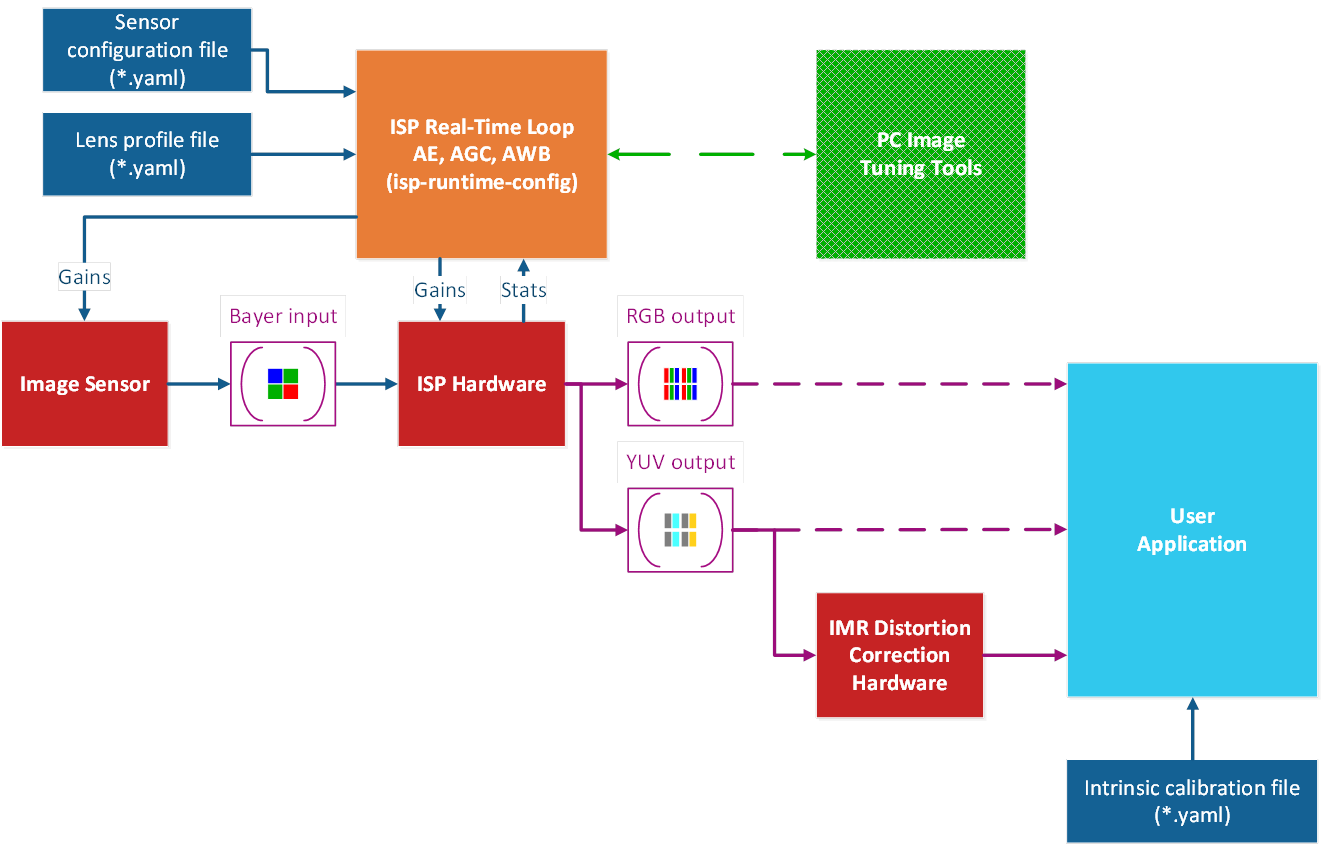

Un ISP es un bloque de hardware especializado, normalmente integrado en el SoC de un smartphone o una cámara, encargado de transformar los datos brutos que captura el sensor en una imagen utilizable. Realiza el posprocesado del flujo que sale del sensor: corrección lineal, reducción de ruido, reparación de píxeles defectuosos, interpolación, balance de blancos, exposición automática, demosaico, ajuste de color y compresión, entre otras tareas.

Su misión es conseguir que la cámara reproduzca los detalles de la escena bajo condiciones de luz muy distintas. En gran medida, el ISP determina el resultado final: nitidez percibida, fidelidad cromática, textura de piel, limpieza del cielo, brillo de luces altas y detalle en sombras.

Además del procesado puramente fotográfico, los ISPs modernos pueden activar funciones de reconocimiento de caras, detección de escenas, control de exposición y enfoque inteligentes. En móviles, muchas mejoras aparente “mágicas” (HDR inteligente, retratos con buen recorte, escenas nocturnas) se apoyan directamente en lo que hace el ISP.

Arquitectura y funciones clave de un ISP

Para entender su impacto, conviene desglosar sus bloques principales y las tareas que ejecuta. Aunque cada fabricante implementa su propia receta, la arquitectura típica incluye módulos de conversión, procesado digital y memoria bien orquestados.

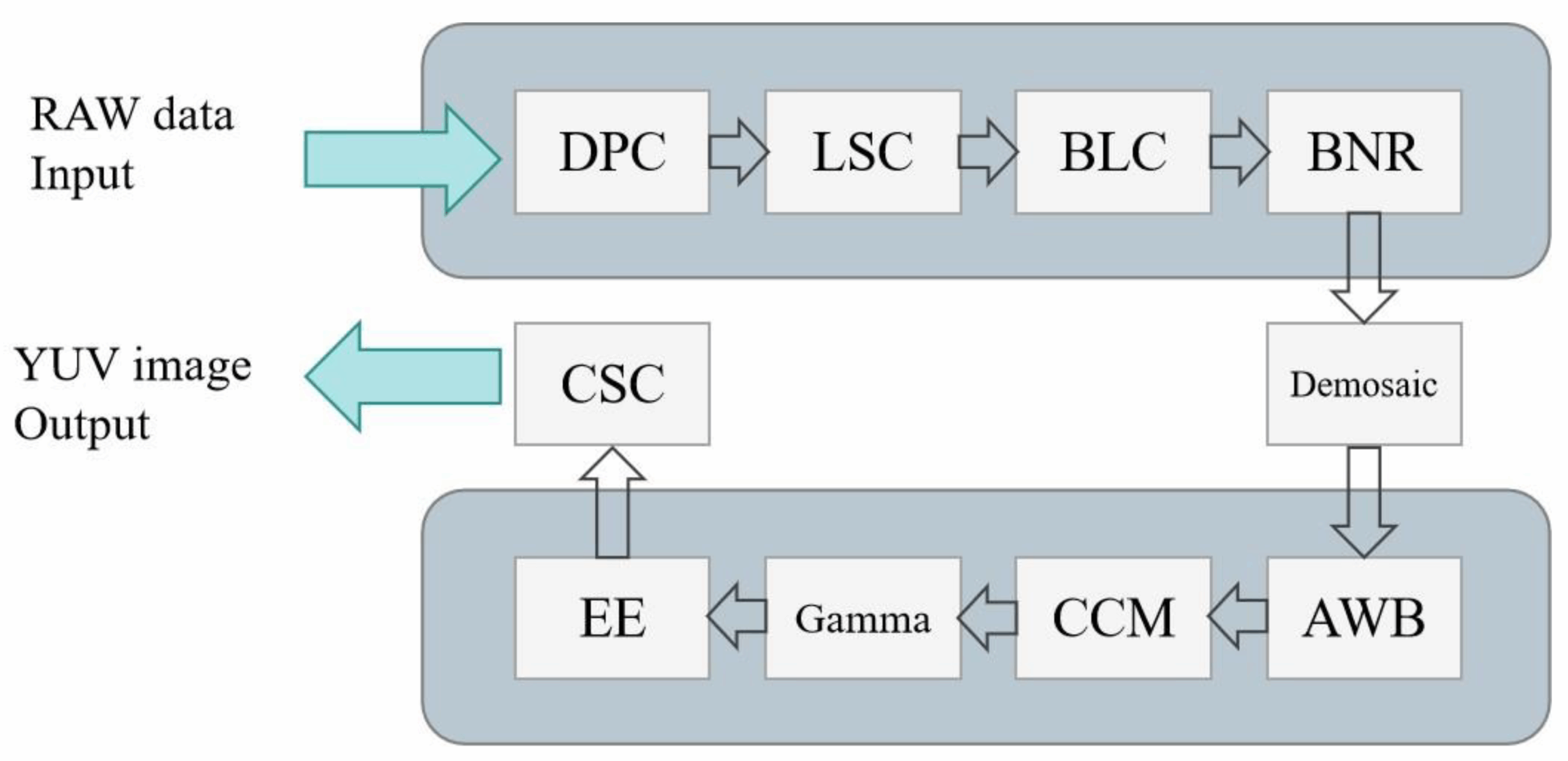

- Convertidor A/D: convierte la señal analógica que sale del sensor en datos digitales; es la base para todo el pipeline de imagen.

- Procesador de señal digital (DSP/ISP core): ejecuta algoritmos de mejora: demosaico, reducción de ruido, balance de blancos, corrección de color, gamma, nitidez, etc.

- Unidades de memoria y búferes: almacenan datos crudos e intermedios; son cruciales para procesado multi-frame y HDR.

Entre sus funciones más conocidas están:

- Reducción de ruido: suaviza el grano, sobre todo en alta sensibilidad o poca luz, intentando preservar texturas finas.

- Corrección de color: ajusta matrices y curvas para que los colores queden cercanos a la escena real.

- Exposición y enfoque automáticos: mide la luz y estima puntos de enfoque para minimizar ajustes manuales.

- Balance de blancos: compensa la temperatura de color para que los tonos neutros no viren a amarillo/azul.

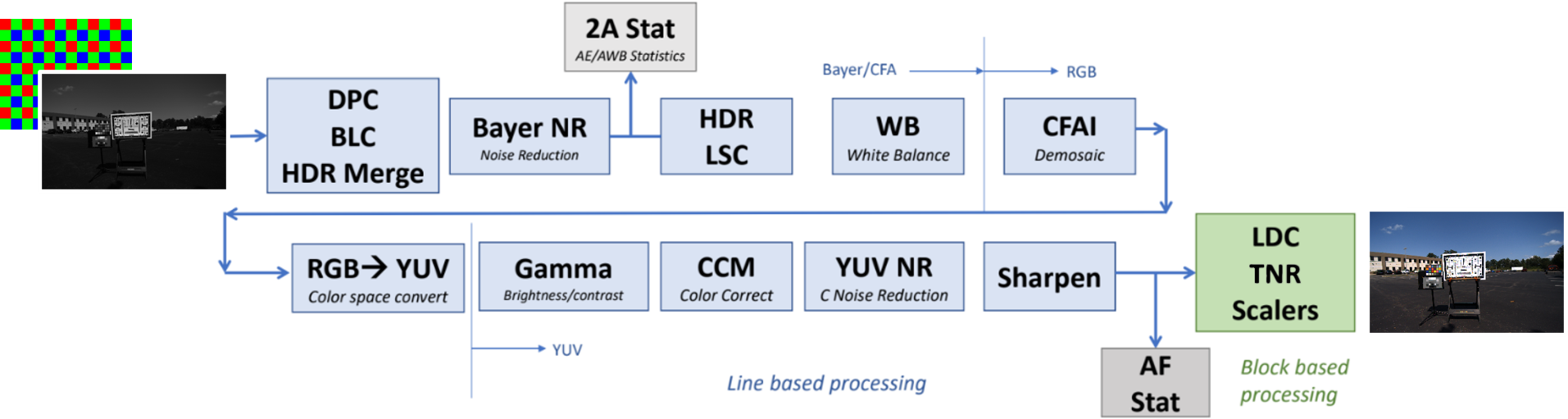

- Demosaico (de-Bayer): reconstruye los tres canales RGB a partir del patrón Bayer, rellenando color que falta en cada píxel.

- Compresión: genera archivos eficientes (p. ej., JPG) optimizando almacenamiento y transmisión.

A todo esto se suman correcciones ópticas (viñeteo, distorsión en ultra gran angular u ojo de pez), cálculo de HDR, o integración con detección de caras y escenas, cada vez más apoyadas en modelos de IA.

Cómo es el flujo de procesamiento de imagen

El pipeline de imagen de un ISP comprende varias etapas, desde la captura hasta el archivo final. Aunque cada fabricante afina los pasos, el esquema general sigue esta secuencia lógica:

- Captura y digitalización: el sensor registra la escena y el ISP convierte la señal mediante A/D para trabajar en digital.

- Preproceso y análisis: segmenta zonas, extrae características y patrones (caras, texto, escenas) y prepara el material.

- Núcleo de procesado: aplica reducción de ruido, balance de blancos, corrección de color, exposición y demosaico.

- Ajustes avanzados: corrige gamma, realiza afinado de nitidez, reduce artefactos y estabiliza si procede.

- Salida y compresión: guarda en RAW/JPG/HEIF o vuelca a la cadena de vídeo, con el tamaño y calidad esperados.

En móviles, este proceso ocurre cuando previsualizas la escena y al disparar. El ISP combina múltiples frames en HDR, fusiona exposiciones y decide cómo equilibrar detalle y limpieza del ruido en tiempo real.

Tipos de ISP: interno e integrado frente a externo y dedicado

Existen ISPs integrados en el propio sensor o en el SoC, y otros externos (chips dedicados). Un ISP interno suele cubrir lo básico a bajo coste, típico de cámaras sencillas o móviles económicos.

Los ISPs externos añaden músculo para módulos de cámara de alta gama o necesidades profesionales, con mejor calidad y flexibilidad a costa de precio y complejidad. Ojo: un ISP dedicado no garantiza por sí mismo mejor imagen; la clave es la sintonía entre sensor (CMOS/CCD), ISP y algoritmos.

Más allá de los megapíxeles: por qué el ISP manda

Los fabricantes han apostado fuerte por el “marketing de números”: más cámaras y más megapíxeles. Aun así, hay cosas más importantes que el conteo de píxeles: la óptica, cómo se usan las cámaras y, sobre todo, el tratamiento que aplica el ISP. Es el encargado de poner orden en el caos de datos del sensor y convertirlos en una imagen equilibrada.

Cuando disparas, el sensor registra cada píxel bajo filtro Bayer (patrón con rojo, verde y azul). El ISP combina la información de color, corrige exposición, aplica HDR si hace falta, endereza distorsiones de ultra gran angular y, si el móvil soporta RAW, genera tanto el archivo crudo como el JPG procesado.

ISPs dedicados y ejemplos reales en móviles y cámaras

Para diferenciarse, algunas marcas implementan ISPs propios: OPPO desarrolló MariSilicon X para controlar al detalle su procesado, y Xiaomi integró su Surge C1 en determinados modelos, esquivando el ISP Spectra del Snapdragon 888 cuando conviene. Esta personalización explica por qué, con sensores parecidos, dos móviles acaban ofreciendo “firma” de imagen distinta.

En el ecosistema de procesadores, abundan nombres propios: Canon DIGIC, Nikon Expeed, Olympus TruePic, Panasonic Venus Engine, Sony Bionz, Google Pixel Visual Core, Intel IPU, MediaTek Imagiq, Samsung DRIMe, Leica Maestro (sobre Milbeaut), Pentax PRIME, Ricoh GR Engine, Sharp ProPix, Socionext Milbeaut, UNISOC Vivimagic, THine THP, HTC ImageSense, Casio EXILIM Engine, Epson EDiART, Sanyo Platinum, Sigma True o incluso los históricos ATI Imageon. Cada uno aporta su pipeline optimizado y trucos propios.

El caso de MediaTek Imagiq es ilustrativo: fue diseñado para manejar grandes volúmenes de datos, especialmente con sensores duales. Permite combinar cuatro imágenes para evitar trepidación, reducir ruido de forma agresiva y previsualizar en directo efectos de desenfoque de fondo. En vídeo, llega a cámara lenta 480 fps en Full HD y soporta grabación 4K con HDR, además de un autofoco a nivel de píxel muy veloz.

Procesado asistido por IA: el salto del AI‑ISP

La integración de IA en el pipeline del ISP ha sido un salto claro. Un AI‑ISP es capaz de mejorar resolución aparente, limpieza en sombras y reproducción de color con menos artefactos. En nocturnas, donde elevar brillo introduce ruido, la IA ayuda a mantener mejor equilibrio entre claridad y fidelidad cromática.

Fabricantes de silicio han movido ficha: Ambarella anunció un ISP con motor CVflow para usar redes neuronales directamente en el pipeline, mejorando color en baja luz y rango dinámico; Arm presentó Mali‑C55 para visión embebida con mejor calidad en condiciones adversas. La idea es clara: mezclar hardware ISP clásico con aceleradores de IA para ir más allá de lo que permiten filtros tradicionales.

Relación con sensores, CPU/GPU y software: equilibrio total

El sensor es daltónico: sus fotodiodos miden luminancia y dependen del mosaico de filtros de color (Bayer) para reconstruir RGB. El ISP evalúa brillo y color por píxel, compara vecinos, demosaiciza, ajusta gamma para tonos medios (piel, cielo) y aplica nitidez con detección de bordes para no pasarse.

CMOS y CCD han convivido mucho tiempo, con ventajas e inconvenientes: hoy domina CMOS por consumo y velocidad, pero la calidad final no depende solo del tipo de sensor. Lo determinante es la cooperación entre sensor, ISP, CPU/GPU y algoritmos. Una gran CPU/GPU no arregla un mal pipeline de imagen, ni un super ISP lucirá con un sensor mal calibrado.

El software cuenta, y mucho: tras disparar, el sistema genera un archivo crudo y lo somete a compresión y optimización hasta el JPG que ves. El color, el tono y la reducción de ruido varían según el fabricante porque la receta de procesado es distinta. Aun así, el software es la última barrera de compensación: si el sensor, el módulo de cámara o el ISP están por debajo, no hace milagros.

En la práctica, el SoC reúne CPU, GPU, ISP, NPU/AI y otros bloques en un único chip. En móviles, los cores ARM con NEON (SIMD) apoyan tareas multimedia, mientras bibliotecas como libcamera habilitan el uso de pipelines ISP en Linux y sistemas embebidos.

Aplicaciones del ISP: de la foto móvil a la medicina

El ISP es omnipresente: en smartphones para mejorar la captura; en cámaras profesionales para maximizar calidad; en sanidad (rayos X, RM) para hacer más legibles las imágenes; en vigilancia para mejorar claridad; y en visión por computador (robótica y coches autónomos) para alimentar con imágenes limpias a los algoritmos de percepción.

- Fotografía móvil: HDR, nocturnos, retratos con recorte y fusión multi-frame.

- Pro: fidelidad de color, control fino de ruido y texturas, RAW de calidad.

- Médico: optimización de contraste y reducción de artefactos para diagnóstico.

- Seguridad: nitidez y estabilidad con poca luz y altas ISO.

- Automoción: soporte a ADAS con pipelines robustos para cámaras perimetrales.

Cómo elegir un ISP para un dispositivo o proyecto

La elección del ISP depende de varios factores: requisitos de calidad de imagen, presupuesto, compatibilidad con sensores, consumo energético, velocidad y escalabilidad. En productos profesionales buscando resolución y color de referencia, un ISP externo puede tener sentido; en móviles, prioriza integración y eficiencia.

También conviene valorar si el ISP incorpora soporte de IA en el pipeline, la latencia en previsualización, el rendimiento en HDR multi-frame, y la disponibilidad de SDK y herramientas (p. ej., sintonía de AWB, AE, reducción de ruido, mapas de tono). La “afinación” entre sensor e ISP es tanto arte como ciencia.

Mercado y tendencias: crecimiento constante, IA al frente

El mercado de ISPs y procesadores de visión crece a una CAGR cercana al 6,9%, impulsado por electrónica de consumo, automoción, fabricación y salud. Drones y cámaras para seguridad empujan fuerte, igual que la demanda de visión embebida con IA en el borde.

Los drivers principales son la necesidad de más cómputo, la adopción de visión por computador y la integración de IA/ML, aunque los costes de producción de SoC e ISPs potentes son elevados. La pandemia ralentizó fabricación y consumo, afectando semiconductores, pero la demanda se ha normalizado y apunta al alza.

En consumo, los ISPs/VPU dominan por la presión de ofrecer mejor cámara y experiencias premium. En APAC se prevé la mayor CAGR por concentración de fabricantes de sensores, cámaras inteligentes y startups de IA; países como Japón y China concentran producción y alianzas estratégicas (p. ej., fábricas de TSMC con colaboración de Sony).

Noticias recientes muestran la tendencia: Arm lanzó Mali‑C55 para visión de IoT, Ambarella introdujo AISP con IA integrada en el pipeline, STMicroelectronics presentó su ISPU (unidad de procesamiento de sensores inteligente) que combina DSP e IA en el mismo silicio, y actores como Cadence y Light trabajan en percepción de profundidad para ADAS. La foto es clara: más IA embebida, mejor HDR y nocturna, y pipelines optimizados para latencia y consumo.

Ecosistema y puntos técnicos a tener en cuenta

En digital, el ruido es inevitable y crece con temperatura y tiempos de exposición. Al subir ISO, amplificas señal y también ruido, de modo que el ISP debe distinguir textura de grano para no “lavar” la imagen. La nitidez se aplica con detección de bordes para preservar profundidad y microcontraste sin halos.

El control de gamma ajusta el rango de tonos medios para que pieles y cielos se vean naturales. El demosaico de Bayer reconstruye color por píxel con interpolación, y la corrección de distorsión y viñeteo compensa las limitaciones ópticas, sobre todo en ultra gran angular. La compresión reduce tamaño manteniendo equilibrio entre detalle y artefactos.

Finalmente, recuerda que muchas diferencias entre marcas vienen de su pipeline: matrices de color, curvas de tono, política de reducción de ruido, grado de nitidez, cómo resuelven el HDR y si apoyan el proceso en IA. Por eso dos dispositivos con el mismo sensor entregan resultados muy distintos.

Queda claro que el ISP es el núcleo silencioso que equilibra hardware y algoritmos para llevar la señal del sensor al resultado que ves y compartes, ya sea una foto con un cielo suave y piel natural o un vídeo 4K con HDR fluido y bien expuesto. Cuando el sensor, el módulo óptico, el ISP y el software reman en la misma dirección, el salto de calidad es evidente en cualquier condición de luz.