- GB300 duplica capacidades clave: 288 GB HBM3E y NVLink 5 a 1,8 TB/s.

- PCIe 6.0, 20.480 CUDA y 640 Tensor Cores elevan el rendimiento AI.

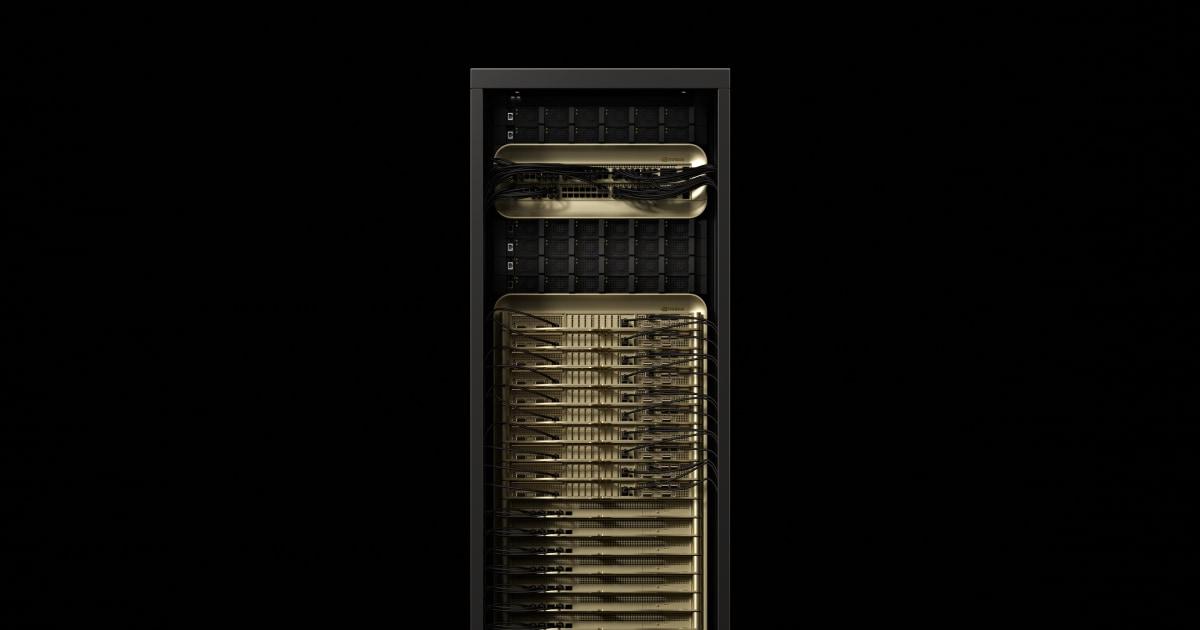

- NVL72 integra 72 GPUs con 130 TB/s; despliegue y cableado optimizados.

- TCO competitivo frente a la nube y salto al formato sobremesa con ASUS.

La llegada de la NVIDIA Blackwell Ultra GB300 marca un antes y un después en aceleración para inteligencia artificial y HPC, situando a NVIDIA un paso por delante en plena carrera por la IA generativa y el cómputo a gran escala. Este nuevo acelerador toma el relevo del GB200 con un salto en memoria, interconexión y eficiencia que lo convierte en la nueva referencia del sector.

En un mercado donde AMD empuja con sus Instinct de última generación y asoma en el horizonte la arquitectura Rubin, NVIDIA aprieta el acelerador con una propuesta ambiciosa: más capacidad de memoria HBM3E, conectividad NVLink 5 de altísimo ancho de banda, soporte para PCIe 6.0 y un diseño multi-die que exprime el nodo TSMC 4NP. Hablamos de una plataforma pensada para entrenar y desplegar LLMs gigantes, simulaciones y cargas de producción reales, no de una GPU para consumo doméstico.

Qué es la NVIDIA Blackwell Ultra GB300 y por qué importa

La GB300 Blackwell Ultra es el acelerador tope de gama dentro de la familia Blackwell y la última gran iteración antes del salto a Rubin. Se trata de un hardware concebido para centros de datos, clústeres de investigación y fábricas de IA, con foco tanto en entrenamiento como en inferencia a gran escala.

El objetivo de NVIDIA no es únicamente subir la potencia bruta, sino mejorar el rendimiento efectivo de los pipelines de IA de principio a fin. Por eso combina mayores FLOPS útiles, más memoria local, enlaces de alta velocidad entre chips y garantías de fiabilidad, seguridad y aislamiento en despliegues multiinquilino mediante MIG.

Lo interesante es que todo esto llega con disponibilidad en configuraciones de servidor de gran densidad, como los racks NVL72 (también referidos en algunas fuentes como NV72). La visión es clara: escalar desde un nodo hasta centenares de GPUs con la menor fricción posible, manteniendo latencias bajas y ancho de banda sostenido dentro del tejido NVLink.

Arquitectura Blackwell Ultra en detalle

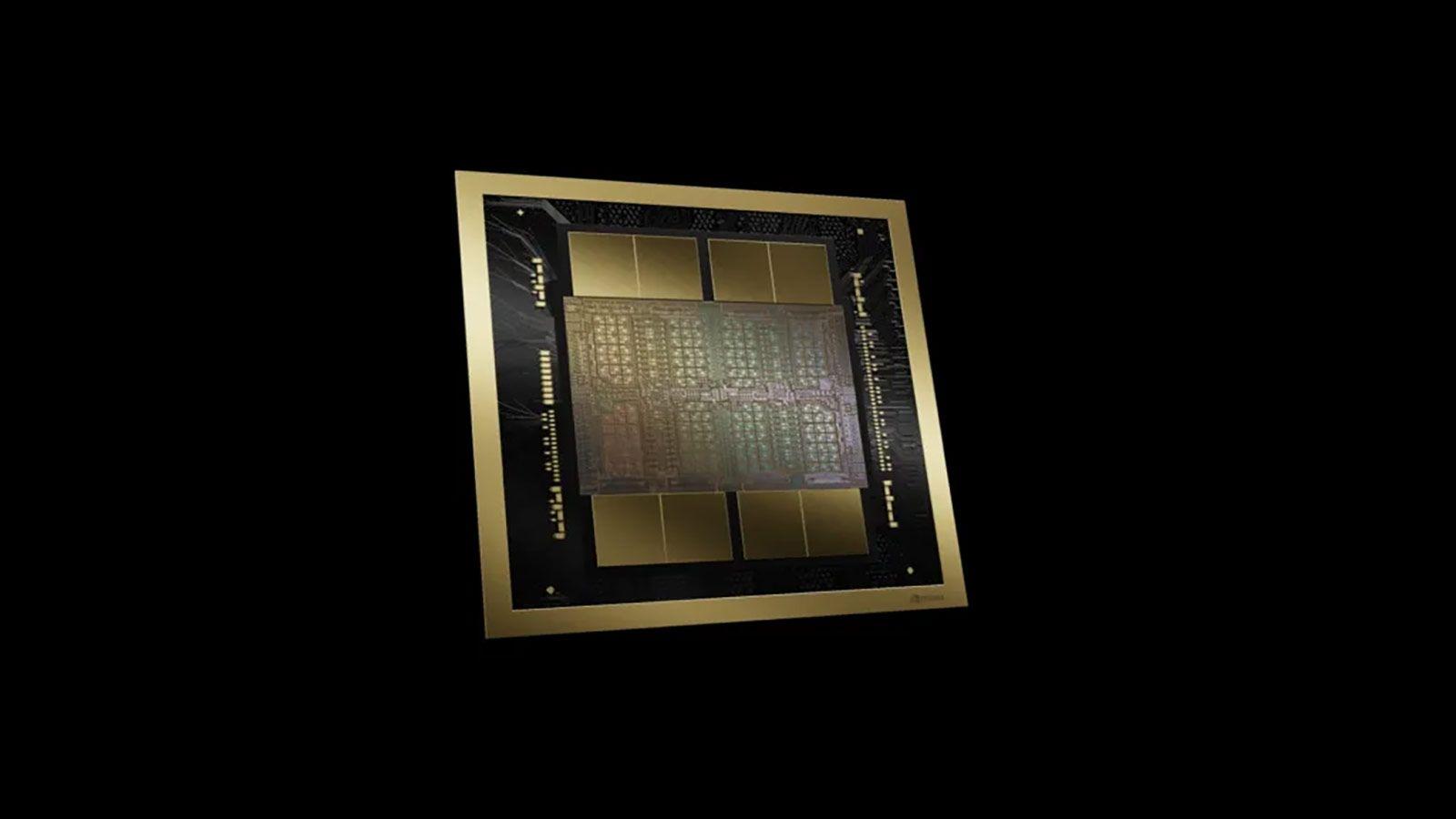

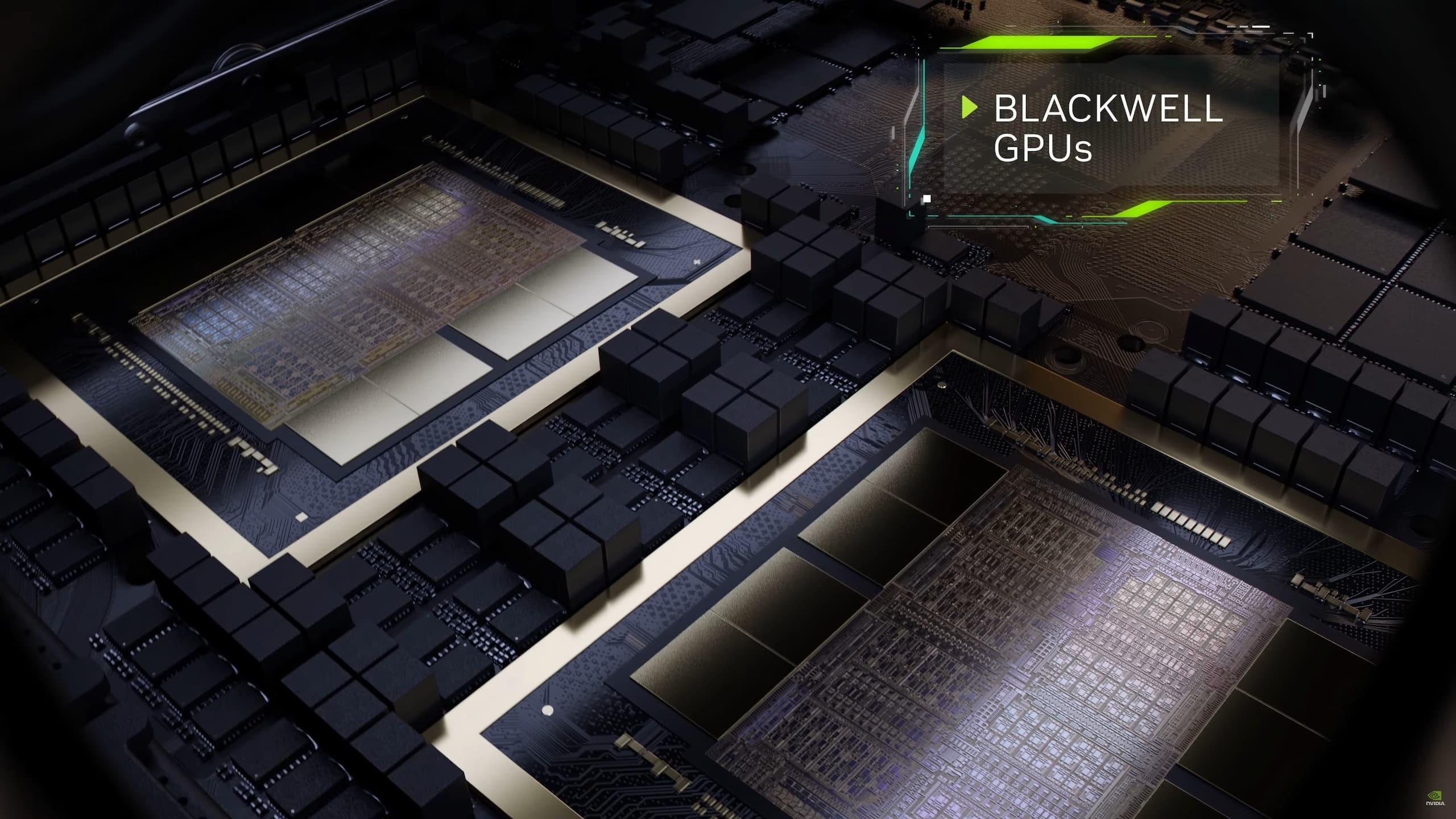

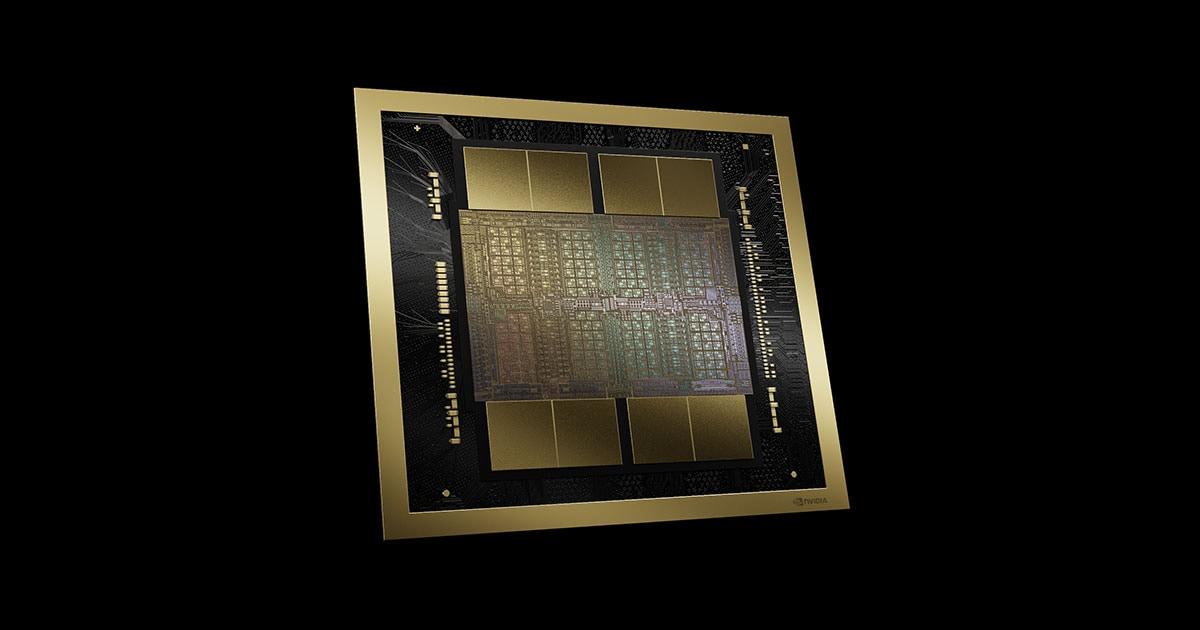

El corazón del GB300 es un diseño de dos dados unidos por la interfaz NV-HBI que operan como una sola unidad lógica. Fabricado en TSMC 4NP, integra 208.000 millones de transistores y un enlace interno de 10 TB/s, asegurando que los dos troqueles comparten datos a enorme velocidad.

En cómputo, la cifra impresiona: 160 SM, 20.480 núcleos CUDA y 640 Tensor Cores de 5.ª generación. Estas unidades añaden compatibilidad con formatos como FP8, FP6 y el nuevo NVFP4, que reduce el consumo de memoria frente a FP16 y permite mayor densidad de batch y contexto en cargas de IA avanzadas.

Blackwell incorpora además 40 MB de Tensor Memory (TMEM) distribuida en los SM, una caché extremadamente útil para acelerar patrones de acceso típicos en entrenamiento e inferencia. Esto, unido a las mejoras de las unidades Tensor, se traduce en mayor rendimiento por vatio y mejor aprovechamiento de la memoria HBM.

En cifras de rendimiento, NVIDIA sitúa la GB300 con incrementos de hasta el 50% frente al GB200 en modos de baja precisión optimizados para IA (NVFP4), alcanzando del orden de 15 PFlops en NVFP4 y hasta 20 PetaFLOPS de potencia AI según configuración y carga. La clave no es solo el pico teórico, sino la capacidad de sostenerlo con un ancho de banda de memoria e interconexión a la altura.

Memoria HBM3E, PCIe 6.0 y consumo

Uno de los saltos más notables de la GB300 es la memoria local: 8 pilas de HBM3E (12-Hi) para un total de 288 GB con 8 TB/s de ancho de banda. Esto supone una mejora sustancial frente a generaciones previas y abre la puerta a entrenar modelos de más de 300.000 millones de parámetros sin necesidad de particionar agresivamente.

Además de la capacidad, el subsistema de memoria llega con un bus de 8.192 bits y optimizaciones de acceso que, combinado con NVFP4 y FP8, comprimen las necesidades de almacenamiento intermedio. En pruebas internas, NVIDIA apunta a reducciones de tiempo de entrenamiento de hasta el 40% en escenarios reales gracias a la combinación de más memoria local, mayor ancho de banda y nuevas precisiones.

En conectividad con el host, la GB300 estrena PCIe 6.0 x16 con 256 GB/s bidireccionales, duplicando el caudal respecto a PCIe 5.0. Para topologías con CPU Grace, el enlace directo NVLink-C2C alcanza 900 GB/s, creando un espacio de memoria unificada con coherencia de caché altamente eficiente.

Todo este músculo requiere energía. El TGP del acelerador sube hasta 1.400 W, por lo que las soluciones de refrigeración líquida y la planificación térmica/eléctrica pasan a ser indispensables en cualquier despliegue serio. En data centers modernos esto ya es la norma, pero conviene dimensionar bien la infraestructura auxiliar para evitar cuellos de botella térmicos.

Interconexión NVLink 5, NVSwitch y tejido a gran escala

La quinta generación de NVLink dobla la apuesta por el escalado horizontal. Cada GPU GB300 dispone de 1,8 TB/s por chip con NVLink 5, gracias a 18 enlaces operando con señalización a 200 Gbps por enlace. Los NVSwitch de última generación orquestan la comunicación con una latencia de conmutación de 300 ns, habilitando patrones de tráfico GPU-GPU de hasta 576 vías.

El sistema de referencia NVL72 (denominado en algunas fuentes como NV72) integra 72 GPUs Blackwell Ultra en un único rack con 130 TB/s de ancho de banda agregado NVLink. Esta arquitectura hace posible escalar la computación como un único gran acelerador lógico, minimizando la dependencia de la red externa para el tráfico más intensivo.

La conectividad entre racks también se refuerza: SuperNIC ConnectX-8 proporciona 800 Gb/s por GPU, duplicando la generación previa y funcionando con las plataformas InfiniBand Quantum-X800 y Ethernet Spectrum-X de NVIDIA. El objetivo es sostener trabajos de entrenamiento multinodo con el menor overhead y máxima estabilidad.

Más allá de chips y switches, el despliegue de un NVL72 exige ingeniería de cableado y control de integridad de señal. Las prácticas de campo y la topología física importan tanto como las cifras de datasheet, y aquí NVIDIA y sus socios han documentado configuraciones y métricas de referencia.

Arquitectura de cableado (referencia NVL72):

- Intra‑rack: 1.728 cables Twinax de cobre (impedancia 75 Ω, longitudes <5 m).

- Entre bastidores: 90 puertos QSFP112 con transceptores 800G sobre OM4 MMF.

- Almacenamiento/gestión: 18 DPU BlueField‑3 con enlaces duales de 800G.

Métricas de campo y mejores prácticas:

- Presupuesto óptico: 1,5 dB de pérdida de inserción en tramos OM4 de 150 m.

- BER sostenido < 10⁻¹⁵ en pruebas de estrés de 72 horas.

- Densidad: 1.908 terminaciones por rack (alimentación incluida).

- Envío de troncales preterminados de 144 fibras con pulido APC y verificación IL/ORL conforme TIA‑568.

- Instalación de fibra NVL72 por equipo experto de dos personas en ≈2,8 horas (vs ≈7,5 h in situ).

- Integridad de señal: NVLink‑5 opera a 25 GBd PAM‑4; típicamente 2,1 dB de pérdida por conexión Twinax y <120 fs de jitter RMS con guiado y ferritas adecuados.

Rendimiento real, despliegue en CPDs y TCO vs nube

Los primeros informes de implantación arrojan cifras sólidas bajo cargas de producción. En razonamiento y generación, GB300 NVL72 acelera el throughput por usuario y por megavatio frente a Hopper, con mejoras de hasta 10× en tokens/s por usuario y 5× en TPS por MW, lo que combinadas pueden llegar a 50× en salida de fábrica de IA.

Ejemplos de rendimiento reportado (modelos y tareas conocidas) ponen números a esa mejora: DeepSeek R1‑671B con hasta 1.000 tokens/s sostenidos, GPT‑3 175B rondando 847 tokens/s por GPU de media, Stable Diffusion 2.1 generando 14,2 imágenes/s a 1024×1024 y ResNet‑50 para ImageNet con 2.340 muestras/s sostenidas en entrenamiento.

En eficiencia, se han medido 1,42 GFLOPS/W por rack a un 95% de utilización de GPU, y 1,38 GFLOPS/W en clústeres de 10 racks (el overhead de refrigeración reduce ligeramente la cifra). Incluso en reposo, la red interna consume: ≈3,2 kW por rack considerando NVSwitch y transceptores.

El impacto de los ciclos térmicos también está caracterizado: tras ≈2.000 horas de producción, algunas instalaciones informan de una degradación del 0,3% atribuida al bombeo del material de interfaz térmica (TIM). Programar el reemplazo del TIM cada ≈18 meses mantiene el rendimiento máximo a largo plazo.

Requisitos de despliegue en CPD (checklist resumida):

- Estructura: carga de suelo certificada ≥ 14 kN/m² (≈2.030 psf); en Zonas sísmicas 4, arriostramiento en X conforme IBC 2021; aislamiento de vibraciones <0,5 g de 10–1000 Hz.

- Eléctrica: doble acometida 415 V / 160 A con medición Schneider PM8000; SAI de 150 kVA por rack (125% margen) con doble conversión; puesta a tierra aislada con <1 Ω al MGB.

- Refrigeración: refrigerante <50 µS/cm, 30% propilenglicol, pH 8,5–9,5; filtros plisados 5 µm/1.000 h y finales 1 µm/2.000 h; detección de fugas en QDC con sensibilidad 0,1 ml.

- Repuestos: 1 bandeja NVSwitch (lead time ≈6 semanas), 2 cartuchos de bomba CDU (MTBF ≈8.760 h), 20 transceptores QSFP112 (tasa de fallo ≈0,02% anual), TIM de emergencia (Honeywell PTM7950, 5 g).

- Soporte: SLA de respuesta in situ en 4 horas como estándar del sector; los mejores socios mantienen >99% de disponibilidad en varios países.

El coste total de propiedad frente a la nube invita a hacer números. Tomando como referencia que ciertos proveedores ofrecen B200 desde 2,99 $/hora con compromisos multianuales, un rack NVL72 con GB300 se sitúa en un CapEx de 3,7–4,0 M$ (incluidos repuestos y utillaje) a 36 meses. A esto hay que añadir unos 310.000 $ en energía (0,08 $/kWh, 85% de uso medio), 180.000 $ en infraestructura de refrigeración y 240.000 $ en personal de operaciones (≈0,25 ETC). Total: 4,43–4,73 M$, comparable a un equivalente en la nube cercano a 4,7 M$.

Con una utilización media sostenida del ≈67%, el punto de equilibrio se alcanza en torno a los 18 meses, considerando depreciación, financiación y coste de oportunidad. Para muchos CFO, el on‑prem bien dimensionado ofrece previsibilidad presupuestaria y evita dependencias de proveedor, especialmente en cargas estables y continuas.

ASUS ExpertCenter Pro ET900N G3: GB300 en una torre de sobremesa

Más allá del CPD, ASUS ha presentado un sobremesa capaz de integrar el superchip Grace + Blackwell: el ExpertCenter Pro ET900N G3. ASUS lleva la GPU NVIDIA GB300 a un PC de escritorio profesional. Esta máquina combina una CPU Grace‑72 Neoverse V2 (ARM) con una GPU Blackwell Ultra y ejecuta NVIDIA DGX OS, en un chasis que, por fuera, podría confundirse con un PC de oficina.

El conjunto suma 784 GB de memoria unificada con coherencia de caché, de los que 288 GB corresponden a HBM3E en la GPU y 496 GB a LPDDR5X junto a la CPU. La comunicación Grace–Blackwell usa NVLink‑C2C a 900 GB/s, y el rendimiento AI anunciado alcanza hasta 20 PetaFLOPS según modo y carga.

Para redes, incorpora ConnectX‑8 SuperNIC con enlaces de 800 Gb/s y soporte para el ecosistema Spectrum‑X. A nivel de expansión, ofrece tres ranuras PCIe x16 de longitud completa y tres M.2 para almacenamiento NVMe. La alimentación contempla conectores ATX/EPS12V estándar y tres 12V‑2×6 capaces de entregar hasta 1.800 W solo a las GPUs, dejando claro su enfoque profesional.

ASUS no ha confirmado precio, pero por configuración se moverá en cifras propias del sector empresarial y científico. No es un equipo de consumo, sino una opción para desarrolladores de IA y centros de datos que necesiten potencia concentrada en una única torre o nodos perimetrales de alta densidad.

La NVIDIA Blackwell Ultra GB300 se consolida como la GPU de referencia para IA y HPC: doble dado con NV‑HBI a 10 TB/s, 20.480 CUDA y 640 Tensor Cores, 288 GB de HBM3E a 8 TB/s, NVLink 5 a 1,8 TB/s, PCIe 6.0 y un ecosistema NVL72 que escala a cientos de GPUs. Sumado a funciones de seguridad (confidential computing, MIG) y herramientas de fiabilidad (RAS), el acelerador está listo para cargas de producción masivas, ya sea en racks dedicados o, sorprendentemente, incluso en una torre profesional como la propuesta de ASUS.