- El análisis de sonido permite medir niveles en decibelios, aplicar ponderaciones A y C y calcular indicadores como Leq y LAeq para evaluar la exposición al ruido.

- Los analizadores de audio y los espectrogramas facilitan la detección de problemas de frecuencia, ruido de fondo y resonancias en salas y sistemas de sonido.

- La combinación de análisis espectral, ecualización, reducción de ruido y compresión multibanda mejora de forma notable la calidad de grabaciones y podcasts.

El análisis de sonido se ha convertido en una herramienta básica tanto para quien trabaja con audio a diario como para cualquiera que quiera entender mejor qué está pasando en sus grabaciones, vídeos o incluso en el ruido de su entorno. Desde medir niveles en decibelios hasta desmenuzar una señal en sus frecuencias, hoy en día es posible hacerlo con un simple móvil o con software profesional de estudio.

A lo largo de este artículo vamos a ver de forma muy detallada cómo se analiza el audio: qué son los decibelios y el Leq, qué papel juegan los filtros A y C, cómo funcionan los analizadores de audio y los espectrogramas, qué frecuencias son más peligrosas para el oído y la estructura, y cómo aplicar todo esto en editores como Adobe Audition o iZotope RX para limpiar un podcast o cualquier grabación.

Qué es el análisis de sonido y para qué sirve

Cuando hablamos de análisis de sonido nos referimos al proceso de medir, visualizar e interpretar diferentes aspectos de una señal acústica. Esto abarca desde el nivel de presión sonora (en dB) hasta la distribución de energía en frecuencia, la dinámica o la evolución del sonido a lo largo del tiempo.

El análisis de audio puede hacerse manualmente, escuchando y ajustando a oído, o de forma automática mediante programas y algoritmos capaces de extraer información de manera masiva. En este último caso, no solo se estudian parámetros técnicos, sino también elementos de contenido: transcripción, intención de la conversación, clasificación de audios por tipo, contexto o emociones.

En entornos profesionales, el análisis de sonido se utiliza para mejorar la calidad de grabaciones musicales, cine, podcasts o emisiones en directo. En otros contextos más técnicos sirve para estudios de ruido ambiental, acústica arquitectónica, evaluación de riesgos laborales por ruido o calibración de equipos de sonido.

Gracias a la evolución del hardware y del software, hoy encontramos analizadores tanto en forma de aplicaciones móviles económicas como de completas suites de análisis que permiten registrar datos, exportarlos, compararlos y generar informes detallados para ingeniería, investigación o control de calidad.

Decibelios, Leq y LAeq: cómo se mide el sonido

La unidad estándar para cuantificar la intensidad sonora es el decibelio (dB), una escala logarítmica. Esto significa que no crece de forma lineal: doblar la intensidad física del sonido supone aproximadamente un incremento de 3 dB, no el doble de dB.

El punto de referencia de 0 dB se sitúa en el umbral de audición humana, es decir, el sonido más débil que una persona media puede percibir en condiciones ideales. A partir de ahí, un sonido de 10 dB tiene una intensidad física diez veces superior a ese umbral, 20 dB supone cien veces más, y así sucesivamente.

Este carácter logarítmico hace que cambios relativamente pequeños en dB se perciban como diferencias muy claras de volumen. Un aumento de 3 dB ya es apreciable, y subidas de 10 dB suelen percibirse como un incremento notable de “cantidad” de sonido, aunque la sensación subjetiva de duplicar el volumen se mueve aproximadamente entre 8 y 10 dB según el contexto y el tipo de señal.

En la práctica, el sonido rara vez es constante: en un entorno real, el nivel varía segundo a segundo. Para resumir esa variación en un solo valor se utiliza el nivel continuo equivalente, conocido como Leq. El Leq condensa toda la energía sonora registrada en un periodo determinado (por ejemplo, 1 minuto, 10 minutos, 1 hora) en un único número en dB.

Cuando ese cálculo de Leq se combina con el filtro de ponderación A, hablamos de LAeq, que es el indicador más usado en normativa de ruido ambiental y laboral. De forma similar puede hablarse de LCeq si se emplea ponderación C, más sensible a frecuencias bajas.

Ponderaciones A y C: adaptando la medición al oído humano

Un sonómetro o analizador puede registrar el nivel “puro” de presión sonora, pero el oído humano no percibe todas las frecuencias con la misma sensibilidad. Por eso se utilizan curvas de ponderación que modifican la medición para aproximarla a cómo escuchamos realmente.

La ponderación A (A-weighting) es la más habitual en medición de ruido ambiental, normativa legal y evaluación de exposición al ruido. Esta curva reduce drásticamente la contribución de las frecuencias muy graves (por debajo de 1 kHz, especialmente por debajo de 200 Hz) y también atenua en el extremo de los agudos por encima de unos 8 kHz.

Con la ponderación A, el analizador es menos sensible a ruidos muy graves o muy agudos que el oído humano percibe con menor intensidad. Este tipo de medición se considera una buena aproximación de la molestia subjetiva de muchos ruidos cotidianos, por lo que verás casi siempre cifras en dB(A) o expresadas como LAeq.

La ponderación C (C-weighting) también atenúa los extremos del espectro, pero lo hace de una forma menos severa en la zona grave. Esto la convierte en una opción más adecuada cuando se quiere tener en cuenta el impacto de bajas frecuencias potentes, como en sistemas de sonido con subgraves potentes, explosiones o mediciones donde el contenido grave tiene un papel protagonista.

En un analizador avanzado puedes elegir entre no aplicar ponderación (medición “flat” o Z-weighting), usar A o usar C, en función de la finalidad del análisis y de si quieres aproximarte más a la percepción humana o al valor físico de la presión sonora.

Aplicaciones móviles de análisis de sonido: ejemplo SmarterSound

Hoy es posible llevar un analizador de sonido completo en el bolsillo gracias a apps para smartphone. Una de ellas es SmarterSound, la versión con publicidad de un analizador profesional que ofrece casi todas las funciones avanzadas de la versión Pro, incluyendo visualización de espectro, registro y exportación de datos.

Este tipo de aplicaciones permiten realizar mediciones tanto en modo vídeo como solo audio. Es decir, puedes grabar un vídeo mientras el sistema mide el nivel sonoro en tiempo real, o bien capturar únicamente el audio cuando no necesitas imagen. Además, añaden funciones prácticas como realizar capturas de cámara (snapshots) durante la medición o guardar grabaciones completas.

Entre las características habituales de un analizador móvil avanzado encontramos opciones como temporizador de grabación para detener el registro tras un tiempo concreto, disparo de grabación activado por nivel sonoro (solo empieza a grabar cuando el ruido supera un umbral), o visualización del espectro de frecuencias tanto en modo estático como en forma de espectrograma en tiempo real.

En lo relativo a la medición, suelen incluir modo Leq continuo (Leq, LAeq, LCeq), promedios móviles de 10 y 60 segundos, indicación del valor máximo y mínimo de pico registrados, y diferentes modos de respuesta del medidor (lenta, rápida o “peak” para capturar transitorios bruscos).

Normalmente también se pueden elegir varias resoluciones de vídeo (VGA, 720p, 1080p), distintos niveles de calidad, y se dispone de un archivo interno donde se organizan las grabaciones, que luego se pueden compartir directamente como archivos de audio/vídeo o como imágenes de las gráficas de niveles.

Otro punto clave es la posibilidad de exportar los datos de medición en formato CSV, lo que permite analizarlos después en hojas de cálculo o software especializado. Además, algunas apps muestran información de ubicación (GPS), dirección, fecha y hora, muy útil en estudios de ruido urbanos o mediciones de campo.

Calibración de apps y diferencias entre dispositivos

Un aspecto que a menudo se pasa por alto es que no todos los móviles miden igual el sonido. Los micrófonos integrados tienen calidades y sensibilidades distintas y, además, el sistema operativo puede aplicar filtros o compresores internos que alteren la señal.

Por eso, las aplicaciones serias de análisis incluyen una herramienta de calibración accesible desde los ajustes. El objetivo es ajustar una corrección (offset) para que la lectura del móvil se aproxime lo más posible al valor real, idealmente comparándola con un sonómetro de referencia calibrado.

Si no tienes un equipo profesional de referencia, se suele recomendar un método casero: buscar una habitación lo más silenciosa posible (dormitorio o baño), cerrar puertas y ventanas, apagar electrodomésticos y esperar a que todo quede en calma. En ese entorno, una lectura en torno a 30 dB(A) es razonable para una vivienda sin ruido exterior excesivo.

Ajustando manualmente la calibración de la app para que marque aproximadamente esos 30 dB en silencio, obtendrás lecturas más coherentes entre distintos móviles. Aun así, hay que recordar que un smartphone calibrado “a oído” no sustituye a un sonómetro clase 1 o 2 cuando se requiere precisión normativa.

Frecuencias de sonido peligrosas para la salud y las estructuras

La peligrosidad del sonido no depende solo del volumen, sino también de la frecuencia y la duración de la exposición. Se considera que por encima de 85 dB(A) la exposición prolongada aumenta el riesgo de pérdida auditiva inducida por ruido, especialmente cuando hablamos de periodos de varias horas al día.

El oído humano es especialmente sensible a la franja entre 2.000 y 4.000 Hz, donde se concentra buena parte de la inteligibilidad del habla. Los sonidos intensos y continuos en este rango son particularmente dañinos porque el sistema auditivo responde con más sensibilidad, lo que genera mayor estrés en las células ciliadas del oído interno.

En el extremo opuesto, las frecuencias extremadamente bajas (infrasonidos y graves intensos) pueden causar molestia física, sensación de presión, mareos o vibraciones en el cuerpo. Si además la intensidad es alta, estas bajas frecuencias pueden interactuar con las estructuras físicas del entorno y provocar vibraciones considerables.

Esto se relaciona con el concepto de frecuencia de resonancia. Todo objeto, estructura o incluso el cuerpo humano tiene una frecuencia natural a la que tiende a oscilar. Cuando el sonido externo coincide con esa frecuencia de resonancia y tiene suficiente energía, la amplitud de vibración se multiplica y se incrementa el riesgo de daños materiales o molestias severas.

En acústica arquitectónica y ambiental, entender y controlar la resonancia es clave para evitar fisuras, ruidos estructurales y fallos en elementos constructivos. En salud humana, ciertas frecuencias excitadas de forma intensa pueden causar malestar marcado, fatiga o, en situaciones extremas, daños físicos. Por eso la gestión de las frecuencias peligrosas, tanto altas como bajas, es una parte central del diseño acústico y de las normativas de protección.

Qué es un analizador de audio y qué mide

Un analizador de audio es, en esencia, un dispositivo o software diseñado para mostrar y medir con precisión diferentes características de una señal de sonido. Puede estar integrado en un aparato de laboratorio, en una mesa de mezclas digital, o ser una aplicación para ordenador o móvil.

Entre las variables que puede visualizar un analizador se encuentran la respuesta en frecuencia (qué frecuencias están presentes y con qué amplitud), los niveles de presión sonora, la dinámica de la señal (diferencias entre partes suaves y fuertes) y otros parámetros más específicos como la distorsión armónica, la relación señal-ruido o la correlación estéreo.

Son herramientas especialmente valiosas para ingenieros de sonido, técnicos de directo, productores musicales y entusiastas del audio que quieran tener un control fino de lo que está sucediendo más allá de lo que se percibe al escuchar. La representación visual ayuda a detectar problemas que podrían pasar desapercibidos al oído.

En entornos de mezcla y masterización, un analizador resulta útil para ver el equilibrio de graves, medios y agudos, localizar resonancias molestas, asegurarse de que no hay picos excesivos o bandas de frecuencia totalmente vacías, y en general conseguir una respuesta más homogénea y agradable en distintos sistemas de reproducción.

Cómo funciona un analizador de audio

El funcionamiento básico de un analizador de audio consiste en capturar la señal (mediante un micrófono o una entrada de línea) y procesarla con algoritmos matemáticos que permiten extraer información específica y representarla visualmente.

En el dominio del tiempo, el analizador puede mostrar la forma de onda, es decir, cómo varía la amplitud de la señal según pasa el tiempo. Esta vista es útil para localizar transitorios, golpes, silencios y la estructura temporal general del audio.

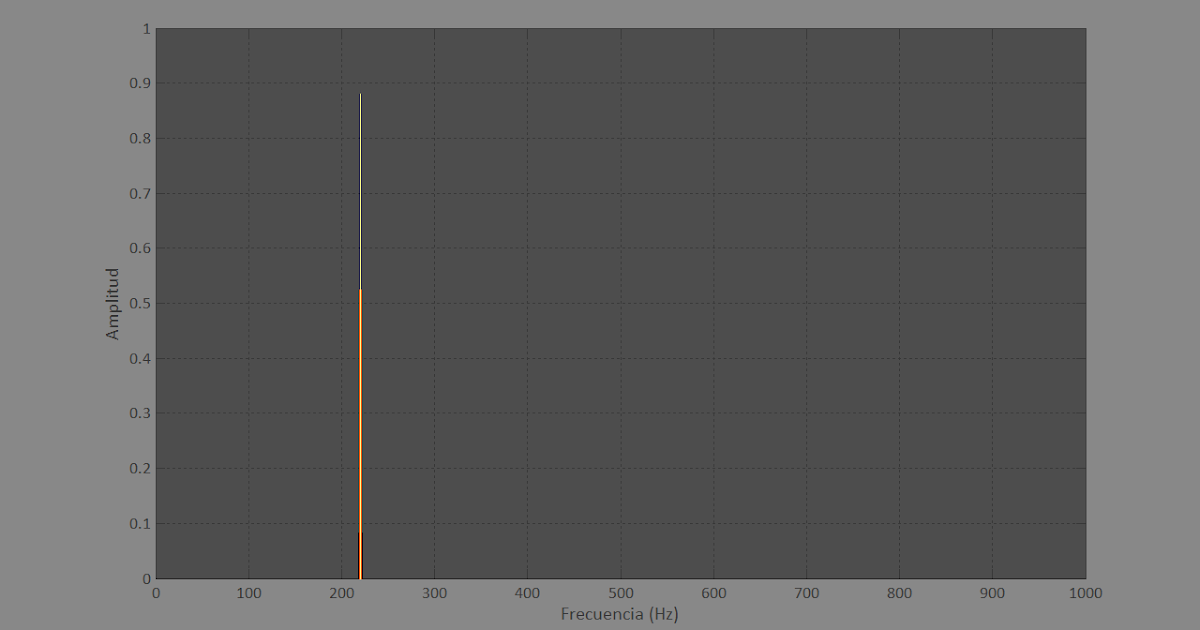

Para estudiar la composición en frecuencias se recurre a la Transformada de Fourier y, en la práctica digital, a la Transformada Rápida de Fourier (FFT). Este algoritmo descompone la señal en una suma de senos y cosenos, proporcionando el espectro: qué frecuencias están presentes y con qué intensidad.

Además, muchos analizadores incluyen modos de espectrograma, donde el tiempo se muestra en un eje, la frecuencia en otro, y la amplitud mediante el color. Así se puede ver cómo cambia el contenido frecuencial a lo largo de la grabación, lo que resulta muy potente para detectar ruidos transitorios, zumbidos constantes o artefactos aislados.

En equipos avanzados, el analizador también calcula niveles promedio (Leq, LAeq, LCeq), valores de pico, promedios temporales de 10 o 60 segundos y otros indicadores estadísticos que ayudan a entender el comportamiento del sonido en un periodo prolongado.

Ventajas de usar un analizador de audio

El primer gran beneficio de contar con un analizador es la posibilidad de monitorizar y ajustar el sonido con mucha precisión. Ver en tiempo real cuál es la respuesta en frecuencia, qué bandas están demasiado presentes o cuáles se quedan cortas, facilita ecualizar de forma más eficiente.

También es una herramienta ideal para la identificación de problemas y su corrección. Picos muy marcados en determinadas frecuencias pueden indicar resonancias no deseadas, feedback, distorsión de algún equipo o un mal posicionamiento de micrófonos o altavoces.

En el diseño de una sala o estudio, el analizador ayuda a evaluar la acústica del espacio: se pueden lanzar señales de prueba (barridos, ruido rosa, etc.) y medir cómo responde la sala en frecuencia y tiempo. Con esa información se planifica mejor la colocación de altavoces y el tratamiento acústico (paneles absorbentes, difusores, trampas de graves).

En sonido en vivo, un analizador se vuelve casi imprescindible para ajustar el sistema de PA y adaptarlo al recinto y al público. Permite ecualizar con rapidez, controlar la aparición de acoples y realizar correcciones en tiempo real cuando cambia la ocupación de la sala o la temperatura.

Espectrogramas y tipos de sonidos: ejemplos habituales

El espectrograma es una representación muy intuitiva en la que cada punto del gráfico indica la energía de una frecuencia concreta en un instante de tiempo, mediante una escala de colores o niveles de gris. Esta vista permite “ver” literalmente el sonido.

En un espectrograma de sonidos armónicos estables (por ejemplo, una nota sostenida de un instrumento de cuerda), se observan líneas horizontales muy definidas: la fundamental y sus armónicos, con amplitud casi constante en el tiempo.

Si analizamos sonidos armónicos cuyos componentes cambian de amplitud, las líneas seguirán estando en las mismas frecuencias pero su intensidad de color variará. Es el caso de un instrumento que toca una nota sostenida pero con vibrato o con cambios de volumen, o de una voz que mantiene un tono pero altera su intensidad.

En sonidos donde los componentes modifican su frecuencia (glissandos, sirenas, portamentos), las líneas dejan de ser horizontales: se curvan, suben o bajan en el eje de frecuencia, mostrando claramente el desplazamiento tonal a lo largo del tiempo.

Si colocamos en el espectrograma ruido blanco y un tono simple a la vez, el tono aparecerá como una línea muy fina a una frecuencia concreta, mientras que el ruido blanco llenará gran parte del espectro con una textura densa y homogénea. Esta comparación es muy útil para entender la diferencia entre sonidos tonales y ruidosos.

En el caso del ruido de tráfico y la voz humana, el espectrograma suele mostrar un “fondo” de energía más o menos constante en el rango grave y medio (motores, rodadura) sobre el que se superponen patrones más definidos de las voces, con energía concentrada en la zona media y algunos formantes más altos.

Fundamentos del análisis espectral de audio

El análisis espectral se centra en estudiar cómo está distribuida la energía de la señal entre las distintas frecuencias. Es una de las herramientas más potentes tanto para la producción musical como para la restauración de audio o el análisis científico.

La base matemática es la Transformada de Fourier (FT), que permite pasar del dominio del tiempo al dominio de la frecuencia. En la práctica digital se utiliza la versión eficiente de este algoritmo: la Transformada Rápida de Fourier (FFT), que reduce drásticamente el coste de cálculo y hace posible el análisis en tiempo real.

En un gráfico espectral clásico vemos en el eje horizontal la frecuencia (Hz) y en el vertical la amplitud (normalmente en dB). Esta vista es ideal para detectar picos en bandas concretas, cortes abruptos o carencias de energía en rangos importantes para la música o la voz.

El espectrograma añade la dimensión temporal: tiempo en el eje horizontal, frecuencia en el vertical, y color como indicador de amplitud. De esta forma se obtiene una “película” del comportamiento frecuencial a lo largo del tiempo, que es especialmente útil para identificar eventos fugaces o ruidos intermitentes.

Cómo interpretar gráficos espectrales

Para leer correctamente un espectrograma hay que fijarse en tres elementos: tiempo, frecuencia y color. El tiempo, en el eje horizontal, muestra el avance de la señal. La frecuencia, en el eje vertical, indica qué tan grave o agudo es cada componente. Y el color representa el nivel de energía de cada punto tiempo-frecuencia.

En muchos programas, los colores cálidos (amarillo, naranja, rojo) se usan para amplitudes altas, mientras que los tonos fríos (azul, verde) indican zonas con poca energía. En una escala de grises, las áreas más claras indican más energía y las más oscuras menos.

Si dividimos el espectro en bandas típicas, encontramos la zona de bajos y subgraves entre 20 Hz y 250 Hz, responsable del peso y el impacto físico de la música, especialmente en géneros como hip-hop o electrónica. En el espectrograma aparece concentrada en la parte inferior.

La región de medios, entre 250 Hz y 4 kHz, es crucial para la inteligibilidad de voces e instrumentos principales. Aquí es donde suelen concentrarse muchos ajustes de EQ porque pequeñas variaciones en esta franja tienen gran influencia en cómo percibimos la mezcla.

Por encima de 4 kHz se ubican los agudos, que aportan brillo, definición y sensación de aire. Un exceso puede resultar estridente o cansado, mientras que una carencia da sensación de audio apagado o “velado”. En el espectrograma se localizan en la parte superior de la imagen.

Detección de problemas mediante análisis espectral

Uno de los usos más interesantes del análisis espectral es la identificación de ruidos de fondo constantes. Por ejemplo, un zumbido de aire acondicionado o un transformador eléctrico aparecerán como líneas horizontales persistentes a frecuencias muy concretas (50 Hz, 60 Hz, sus armónicos), que se mantienen a lo largo de todo el tiempo de la grabación.

Los picos de frecuencia aislados o muy pronunciados pueden indicar fenómenos de feedback, resonancias en la sala o resonancias propias de un micrófono o altavoz. Detectarlos visualmente facilita luego aplicar cortes de EQ quirúrgicos sin tener que barrer frecuencias a ciegas.

También es posible localizar áreas en las que prácticamente no hay energía en ciertas bandas, lo que en ocasiones señala un problema de grabación (micrófono mal posicionado, filtro paso alto excesivo) o una ecualización demasiado agresiva que ha dejado la señal “hueca”.

Configuración del análisis: ventana y tamaño de FFT

Al configurar el análisis espectral en un editor o analizador, hay dos parámetros clave: tipo de ventana y tamaño de la FFT. Ambos determinan la resolución con la que podremos ver y medir la señal.

La ventana (Hann, Hamming, Blackman, etc.) controla cómo se recorta cada fragmento de señal antes de aplicar la FFT. Elegir una u otra afecta a la precisión con la que se delimitan los picos y al nivel de “fugas” de energía entre frecuencias vecinas. La ventana de Hann es una de las más utilizadas por su equilibrio entre resolución temporal y frecuencial.

El tamaño de la FFT determina cuántos puntos se analizan en cada bloque. Una FFT más grande ofrece mejor resolución en frecuencia (permite distinguir frecuencias muy cercanas), pero implica peor resolución temporal (la información se promedia en ventanas más largas).

Por el contrario, tamaños de FFT pequeños mejoran la capacidad para seguir cambios rápidos en el tiempo, pero agrupan varias frecuencias en cada banda, dificultando la identificación precisa de tonos muy cercanos entre sí. La elección depende del tipo de señal y del objetivo del análisis.

Herramientas basadas en el análisis espectral: EQ, reducción de ruido y compresión

Una vez interpretados los gráficos, toca actuar. La primera herramienta obvia es la ecualización (EQ), especialmente la paramétrica. Analizando el espectro es posible localizar exactamente la frecuencia problemática y aplicar un filtro de tipo campana (bell) para atenuarla o realzarla.

En procesos de limpieza, las funciones de reducción de ruido se apoyan intensamente en el análisis espectral. Estos algoritmos aprenden un “perfil” de ruido (por ejemplo, el zumbido de fondo de una grabación) y luego actúan principalmente sobre las regiones del espectro donde ese perfil está presente, intentando preservar el contenido útil.

La compresión multibanda es otra herramienta que bebe del análisis en frecuencia: en lugar de comprimir toda la señal por igual, se divide en varias bandas (graves, medios, agudos) y se aplica compresión independiente en cada una. Así se puede controlar mejor la dinámica del grave sin afectar a la claridad de la voz, o suavizar picos en los agudos sin matar el cuerpo del sonido.

Ejemplo práctico: limpieza de un podcast con Adobe Audition e iZotope RX

El primer paso sería importar el archivo de audio en Adobe Audition. Una vez abierto el programa, cargamos la pista desde el menú de archivo y pasamos a la vista de edición. Desde ahí, cambiamos a la visualización de frecuencia espectral (Spectral Frequency Display), donde veremos el espectrograma completo del audio.

En esa vista, buscamos una sección de la grabación donde solo se escuche el ruido de fondo, sin voces ni otros sonidos relevantes. Seleccionamos esa zona y utilizamos la opción de capturar el perfil de ruido (Capture Noise Print). De este modo, el programa aprende cuál es el “patrón” del zumbido.

A continuación, abrimos el efecto de Noise Reduction (process) y aplicamos la reducción de ruido usando el perfil capturado. Ajustamos la cantidad de atenuación en dB (por ejemplo, 10-20 dB como punto de partida) y el porcentaje de reducción. Conviene previsualizar el resultado y evitar configuraciones demasiado agresivas que puedan dejar artefactos.

Una vez reducido el ruido de fondo, nos centramos en mejorar la claridad de la voz. Volviendo al espectrograma y al análisis de frecuencias, comprobamos que la energía principal de la voz se sitúa entre 250 Hz y 4 kHz. Si las voces suenan “embotadas”, puede haber un exceso en la zona de 200-400 Hz y falta de presencia entre 2-4 kHz.

Abrimos un ecualizador gráfico o paramétrico (por ejemplo, Graphic Equalizer de 10 bandas) y realzamos ligeramente los medios-altos (2-4 kHz) para dar más definición y presencia, mientras atenuamos un poco el rango de bajos-medios (200-400 Hz) si notamos demasiada turbidez.

Para pulir la dinámica general, recurrimos al compresor multibanda. Creamos tres o cuatro bandas (graves, medios, agudos) y aplicamos una compresión suave en la banda de medios donde se concentra la voz, para mantener un nivel más uniforme sin perder naturalidad. En los agudos podemos controlar picos ocasionales (por ejemplo, chasquidos de consonantes) y en los graves contener resonancias no deseadas.

Si disponemos de herramientas como iZotope RX, podemos afinar aún más la restauración. El módulo Spectral Repair permite “pintar” en el espectrograma las anomalías (clics, golpes de micrófono, ruidos puntuales) y repararlas de forma casi quirúrgica, mientras que De-noise ofrece controles avanzados para la reducción de ruido basada en espectro.

El conjunto de estos procesos —reducción de ruido basada en perfil espectral, ecualización guiada por el análisis, compresión multibanda y reparaciones puntuales— permite transformar una grabación con ruido y voces apagadas en un audio mucho más limpio, inteligible y agradable de escuchar.

Todo este recorrido muestra que el análisis de sonido, desde la medición en decibelios y el uso de ponderaciones A y C hasta el empleo de espectrogramas, analizadores de audio y herramientas de restauración, se ha convertido en un aliado imprescindible tanto para controlar el ruido y proteger la salud como para sacar el máximo partido a nuestras grabaciones y sistemas de sonido, combinando rigor técnico con resultados muy audibles en el día a día.